Red social

junio 14, 2014

Red social

Fuente: Wikipedia, Marzo 2013.

Una red social es una estructura social compuesta por un conjunto de actores (tales como individuos u organizaciones) que están conectados por díadas denominadas lazos interpersonales, que se pueden interpretar como relaciones de amistad, parentesco, entre otros.

La investigación multidisciplinar ha mostrado que las redes sociales operan en muchos niveles, desde las relaciones de parentesco hasta las relaciones de organizaciones a nivel estatal (se habla en este caso de redes políticas), desempeñando un papel crítico en la determinación de la agenda política y el grado en el cual los individuos o las organizaciones alcanzan sus objetivos o reciben influencias.

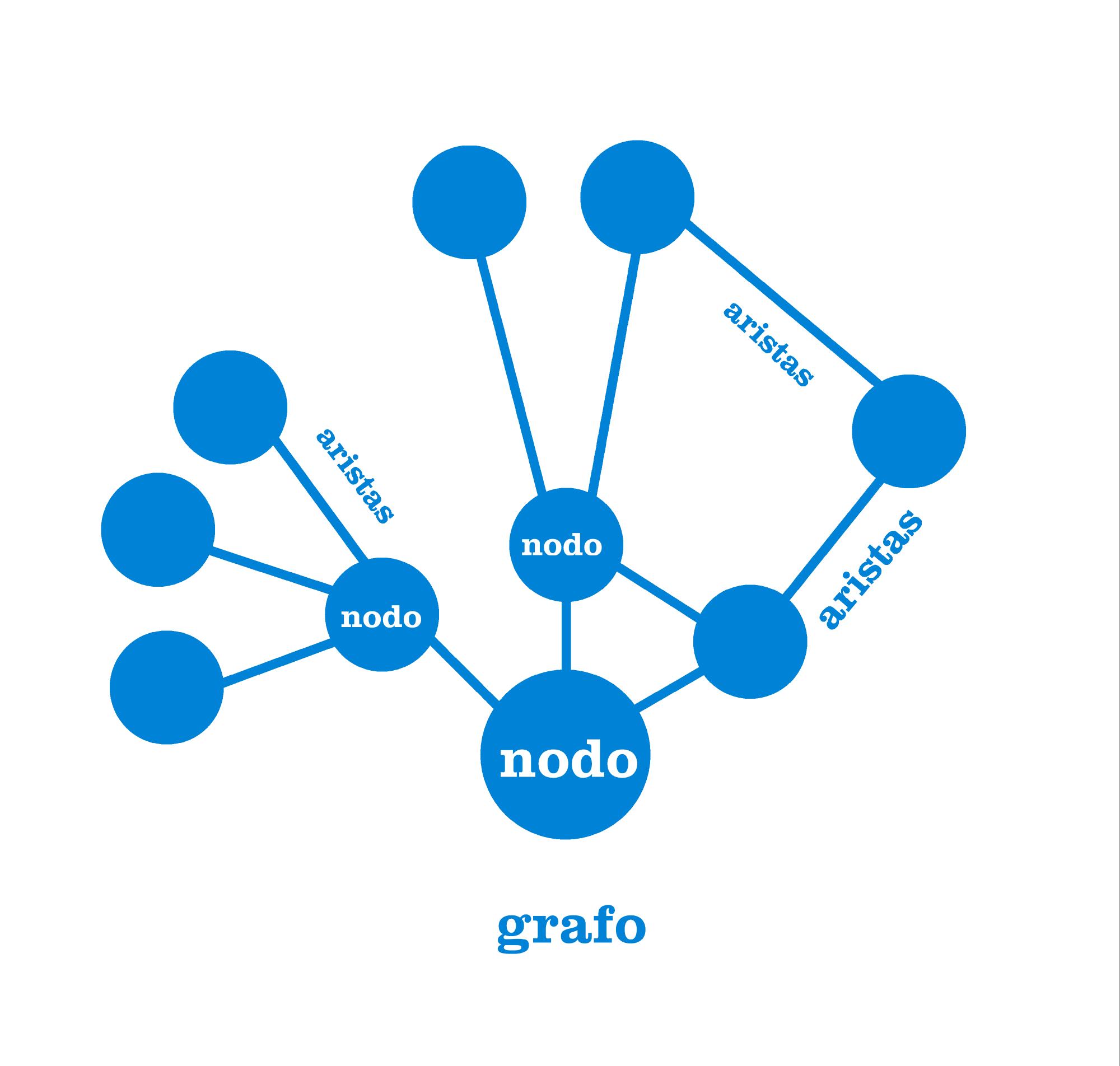

El análisis de redes sociales estudia esta estructura social aplicando la teoría de grafos e identificando las entidades como «nodos» o «vértices» y las relaciones como «enlaces» o «aristas». La estructura del grafo resultante es a menudo muy compleja. Como se ha dicho, En su forma más simple, una red social es un mapa de todos los lazos relevantes entre todos los nodos estudiados. Se habla en este caso de redes «socio céntricas» o «completas». Otra opción es identificar la red que envuelve a una persona (en los diferentes contextos sociales en los que interactúa); en este caso se habla de «red personal».

La red social también puede ser utilizada para medir el capital social (es decir, el valor que un individuo obtiene de los recursos accesibles a través de su red social). Estos conceptos se muestran, a menudo, en un diagrama donde los nodos son puntos y los lazos, líneas.

Red social también se suele referir a las plataformas en Internet. Las redes sociales de internet cuyo propósito es facilitar la comunicación y otros temas sociales en el sitio web.

Análisis de redes sociales

Ejemplo de un diagrama de una red social conocido como grafo social. El nodo con la más alta intermediación centralidad está marcado en amarillo.

El Análisis de redes sociales (relacionado con la teoría de redes) ha emergido como una metodología clave en las modernas Ciencias Sociales, entre las que se incluyen la sociología, la antropología, la psicología social, la economía, la geografía, las Ciencias políticas, la cienciometría, los estudios de comunicación, estudios organizacionales y la sociolingüística. También ha ganado un apoyo significativo en la física y la biología entre otras.

En el lenguaje cotidiano se ha utilizado libremente la idea de «red social» durante más de un siglo para denotar conjuntos complejos de relaciones entre miembros de los sistemas sociales en todas las dimensiones, desde el ámbito interpersonal hasta el internacional. En 1954, el antropólogo de la Escuela de Manchester J. A. Barnes comenzó a utilizar sistemáticamente el término para mostrar patrones de lazos, abarcando los conceptos tradicionalmente utilizados por los científicos sociales: grupos delimitados (p.e., tribus, familias) y categorías sociales (p.e., género, etnia). Académicos como S.D. Berkowitz, Stephen Borgatti, Ronald Burt, Kathleen Carley, Martin Everett, Katherine Faust, Linton Freeman, Mark Granovetter, David Knoke, David Krackhardt, Peter Marsden, Nicholas Mullins, Anatol Rapoport, Stanley Wasserman, Barry Wellman, Douglas R. White y Harrison White expandieron el uso del análisis de redes sociales sistemático.[1]

El análisis de redes sociales ha pasado de ser una metáfora sugerente para constituirse en un enfoque analítico y un paradigma, con sus principios teóricos, métodos de software para análisis de redes sociales y líneas de investigación propios. Los analistas estudian la influencia del todo en las partes y viceversa, el efecto producido por la acción selectiva de los individuos en la red; desde la estructura hasta la relación y el individuo, desde el comportamiento hasta la actitud. Como se ha dicho estos análisis se realizan bien en redes completas, donde los lazos son las relaciones específicas en una población definida, o bien en redes personales (también conocidas como redes egocéntricas, aunque no son exactamente equiparables), donde se estudian «comunidades personales».[2] La distinción entre redes totales/completas y redes personales/egocéntricas depende mucho más de la capacidad del analista para recopilar los datos y la información. Es decir, para grupos tales como empresas, escuelas o sociedades con membrecía, el analista espera tener información completa sobre quien está en la red, siendo todos los participantes egos y alteri potenciales. Los estudios personales/egocéntricos son conducidos generalmente cuando las identidades o egos se conocen, pero no sus alteri. Estos estudios permiten a los egos aportar información sobre la identidad de sus alteri y no hay la expectativa de que los distintos egos o conjuntos de alteri estén vinculados con cada uno de los otros.

Una red construida a partir de una bola de nieve se refiere a la idea de que los alteri son identificados en una encuesta por un conjunto de Egos iniciales (oleada cero) y estos mismos alteri se convierten en egos en la oleada 1 y nombran a otros alteri adicionales y así sucesivamente hasta que el porcentaje de alteri nuevos empieza a disminuir. Aunque hay varios límites logísticos en la conducción de estudios de bola de nieve, hay desarrollo recientes para examinar redes híbridas, según el cual egos en redes completas pueden nombrar a alteri que de otro modo no estarían identificados, posibilitando que éstos sean visibles para todos los egos de la red.[3] La red híbrida, puede ser valiosa para examinar redes totales/completas sobre las que hay la expectativa de incluir actores importantes más allá de los identificados formalmente. Por ejemplo, los empleados de una compañía a menudo trabajan con consultores externos que son parte de una red que no pueden definir totalmente antes de la recolección de datos.

En el análisis de redes sociales, se distinguen varias tendencias analíticas:[4]

No se parte de la hipótesis de que los grupos son los bloques en la sociedad: el enfoque está abierto a estudiar sistemas sociales menos definidos, desde comunidades no locales, hasta enlaces a través de websites.

En lugar de tratar a los individuos (personas, organizaciones, estados) como unidades discretas de análisis, se centra en cómo la estructura de las relaciones afecta a los individuos y sus relaciones.

En contraste con los análisis que asumen que la socialización de las normas determina el comportamiento, el análisis de redes se utiliza para observar el grado en que la estructura y composición de las relaciones entre los individuos afectan a las normas.

La forma de una red social ayuda a determinar la utilidad de la red para sus individuos. Las redes más pequeñas y más estrictas, pueden ser menos útiles para sus miembros que las redes con una gran cantidad de conexiones sueltas (vínculo débil) con personas fuera de la red principal. Las redes más abiertas, con muchos vínculos y relaciones sociales débiles, tienen más probabilidades de presentar nuevas ideas y oportunidades a sus miembros que las redes cerradas con muchos lazos redundantes. En otras palabras, un grupo de amigos que sólo hacen cosas unos con otros ya comparten los mismos conocimientos y oportunidades. Un grupo de individuos con conexiones a otros mundos sociales es probable que tengan acceso a una gama más amplia de información. Es mejor para el éxito individual tener conexiones con una variedad de redes en lugar de muchas conexiones en una sola red. Del mismo modo, los individuos pueden ejercer influencia o actuar como intermediadores en sus redes sociales, de puente entre dos redes que no están directamente relacionadas (conocido como llenar huecos estructurales).[5]

El poder de análisis de redes sociales estriba en su diferencia de los estudios tradicionales en las Ciencias Sociales, que asumen que los atributos de cada uno de los actores -ya sean amistosos o poco amistosos, inteligentes o tontos, etc- es lo que importa. El análisis de redes sociales produce una visión a la vez alternativa y complementaria, en la cual los atributos de los individuos son menos importantes que sus relaciones y sus vínculos con otros actores dentro de la red. Este enfoque ha resultado ser útil para explicar muchos fenómenos del mundo real, pero deja menos espacio para la acción individual y la capacidad de las personas para influir en su éxito, ya que gran parte se basa en la estructura de su red.

Las redes sociales también se han utilizado para examinar cómo las organizaciones interactúan unas con otras, caracterizando las múltiples conexiones informales que vinculan a los ejecutivos entre si, así como las asociaciones y conexiones entre los empleados de diferentes organizaciones. Por ejemplo, el poder dentro de las organizaciones, a menudo proviene más del grado en que un individuo dentro de una red se encuentra en el centro de muchas relaciones, que de su puesto de trabajo real. Las redes sociales también juegan un papel clave en la contratación, en el éxito comercial y en el desempeño laboral. Las redes son formas en las cuales las empresas recopilan información, desalientan la competencia, y connivencia en la fijación de precios o políticas.[6]

Linton Freeman ha escrito la historia del progreso de las redes sociales y del análisis de redes sociales.[7]

Los precursores de las redes sociales, a finales del siglo XVIII incluyen a Émile Durkheim y a Ferdinand Tönnies. Tönnies argumentó que los grupos sociales pueden existir bien como lazos sociales personales y directos que vinculan a los individuos con aquellos con quienes comparte valores y creencias (gemeinschaft), o bien como vínculos sociales formales e instrumentales (gesellschaft). Durkheim aportó una explicación no individualista al hecho social, argumentando que los fenómenos sociales surgen cuando los individuos que interactúan constituyen una realidad que ya no puede explicarse en términos de los atributos de los actores individuales. Hizo distinción entre una sociedad tradicional -con «solidaridad mecánica»- que prevalece si se minimizan las diferencias individuales; y una sociedad moderna -con «solidaridad orgánica»- que desarrolla cooperación entre individuos diferenciados con roles independientes.

Por su parte, Georg Simmel a comienzos del siglo XX, fue el primer estudioso que pensó directamente en términos de red social. Sus ensayos apuntan a la naturaleza del tamaño de la red sobre la interacción y a la probabilidad de interacción en redes ramificadas, de punto flojo, en lugar de en grupos.

Después de una pausa en las primeras décadas del siglo XX, surgieron tres tradiciones principales en las redes sociales. En la década de 1930, Jacob L. Moreno fue pionero en el registro sistemático y en el análisis de la interacción social de pequeños grupos, en especial las aulas y grupos de trabajo (sociometría), mientras que un grupo de Harvard liderado por W. Lloyd Warner y Elton Mayo exploró las relaciones interpersonales en el trabajo. En 1940, en su discurso a los antropólogos británicos, A.R. Radcliffe-Brown instó al estudio sistemático de las redes.[8] Sin embargo, tomó unos 15 años antes de esta convocatoria fuera seguida de forma sistemática.

El Análisis de redes sociales se desarrolló con los estudios de parentesco de Elizabeth Bott en Inglaterra entre los años 1950, y con los estudios de urbanización del grupo de antropólogos de la Universidad de Manchester (acompañando a Max Gluckman y después a J. Clyde Mitchell) entre los años 1950 y 1960, investigando redes comunitarias en el sur de África, India y el Reino Unido. Al mismo tiempo, el antropólogo británico Nadel SF Nadel codificó una teoría de la estructura social que influyó posteriormente en el análisis de redes.[9]

Entre los años 1960 y 1970, un número creciente de académicos trabajaron en la combinación de diferentes temas y tradiciones. Un grupo fue el de Harrison White y sus estudiantes en el Departamento de Relaciones Sociales de la Universidad de Harvard: Ivan Chase, Bonnie Erickson, Harriet Friedmann, Mark Granovetter, Nancy Howell, Joel Levine, Nicholas Mullins, John Padgett, Michael Schwartz y Barry Wellman. Otras personas importantes en este grupo inicial fueron Charles Tilly, quien se enfocó en redes en sociología política y movimientos sociales, y Stanley Milgram, quien desarrolló la tesis de los «seis grados de separación».[10] Mark Granovetter y Barry Wellman están entre los antiguos estudiantes de White que han elaborado y popularizado el análisis de redes sociales.[11]

Pero el grupo de White no fue el único. En otros lugares, distintos académicos desarrollaron un trabajo independiente significativo: científicos sociales interesados en aplicaciones matemáticas de la Universidad de California Irvine en torno a Linton Freeman, incluyendo a John Boyd, Susan Freeman, Kathryn Faust, A. Kimball Romney y Douglas White; analistas cuantitativos de la Universidad de Chicago, incluyendo a Joseph Galaskiewicz, Wendy Griswold, Edward Laumann, Peter Marsden, Martina Morris, y John Padgett; y académicos de la comunicación en la Universidad de Michigan, incluyendo a Nan Lin y Everett Rogers. En la década de 1970, se constituyó un grupo de sociología sustantiva orientada de la Universidad de Toronto, en torno a antiguos estudiantes de Harrison White: S.D. Berkowitz, Harriet Friedmann, Nancy Leslie Howard, Nancy Howell, Lorne Tepperman y Barry Wellman, y también los acompañó el señalado modelista y teorético de los juegos Anatol Rapoport. En términos de la teoría, criticó el individualismo metodológico y los análisis basados en grupos, argumentando que ver el mundo desde la óptica de las redes sociales ofrece un apalancamiento más analítico.[12]

Investigación

El análisis de redes sociales se ha utilizado en epidemiología para ayudar a entender cómo los patrones de contacto humano favorecen o impiden la propagación de enfermedades como el VIH en una población. La evolución de las redes sociales a veces puede ser simulada por el uso de modelos basados en agentes, proporcionando información sobre la interacción entre las normas de comunicación, propagación de rumores y la estructura social.

El análisis de redes sociales también puede ser una herramienta eficaz para la vigilancia masiva – por ejemplo, el Total Information Awareness realizó una investigación a fondo sobre las estrategias para analizar las redes sociales para determinar si los ciudadanos de EE.UU. eran o no amenazas políticas.

La teoría de difusión de innovaciones explora las redes sociales y su rol en la influencia de la difusión de nuevas ideas y prácticas. El cambio en los agentes y en la opinión del líder a menudo tienen un papel más importante en el estímulo a la adopción de innovaciones, a pesar de que también intervienen factores inherentes a las innovaciones.

Por su parte, Robin Dunbar sugirió que la medída típica en una red egocéntrica está limitado a unos 150 miembros, debido a los posibles límites de la capacidad del canal de la comunicación humana. Esta norma surge de los estudios transculturales de la sociología y especialmente de la antropología sobre la medida máxima de una aldea (en el lenguaje moderno mejor entendido como una ecoaldea). Esto está teorizado en la psicología evolutiva, cuando afirma que el número puede ser una suerte de límite o promedio de la habilidad humana para reconocer miembros y seguir hechos emocionales con todos los miembros de un grupo. Sin embargo, este puede deberse a la intervención de la economía y la necesidad de seguir a los «polizones», lo que hace que sea más fácil en grandes grupos sacar ventaja de los beneficios de vivir en una comunidad sin contribuir con esos beneficios.

Mark Granovetter encontró en un estudio que un número grande de lazos débiles puede ser importante para la búsqueda de información y la innovación. Los cliques tienen una tendencia a tener opiniones más homogéneas, así como a compartir muchos rasgos comunes. Esta tendencia homofílica es la razón por la cual los miembros de las camarillas se atraen en primer término. Sin embargo, de forma parecida, cada miembro del clique también sabe más o menos lo que saben los demás. Para encontrar nueva información o ideas, los miembros del clique tendrán que mirar más allá de este a sus otros amigos y conocidos. Esto es lo que Granovetter llamó «la fuerza de los lazos débiles».

Hay otras aplicaciones del término red social. Por ejemplo, el Guanxi es un concepto central en la sociedad china (y otras culturas de Asia oriental), que puede resumirse como el uso de la influencia personal. El Guanxi puede ser estudiado desde un enfoque de red social.[13]

El fenómeno del mundo pequeño es la hipótesis sobre que la cadena de conocidos sociales necesaria para conectar a una persona arbitraria con otra persona arbitraria en cualquier parte del mundo, es generalmente corta. El concepto dio lugar a la famosa frase de seis grados de separación a partir de los resultados del «experimento de un mundo pequeño» hecho en 1967 por el psicólogo Stanley Milgram. En el experimento de Milgram, a una muestra de individuos EE.UU. se le pidió que hiciera llegar un mensaje a una persona objetivo en particular, pasándolo a lo largo de una cadena de conocidos. La duración media de las cadenas exitosas resultó ser de unos cinco intermediarios, o seis pasos de separación (la mayoría de las cadenas en este estudio ya no están completas). Los métodos (y la ética también) del experimento de Milgram fueron cuestionados más tarde por un estudioso norteamericano, y algunas otras investigaciones para replicar los hallazgos de Milgram habrían encontrado que los grados de conexión necesarios podrían ser mayores.[14] Investigadores académicos continúan exploranto este fenómeno dado que la tecnología de comunicación basada en Internet ha completado la del teléfono y los sistemas postales disponibles en los tiempos de Milgram. Un reciente experimento electrónico del mundo pequeño en la Universidad de Columbia, arrojó que cerca de cinco a siete grados de separación son suficientes para conectar cualesquiera dos personas a través de e-mail.[15]

Los grafos de colaboración pueden ser utilizados para ilustrar buenas y malas relaciones entre los seres humanos. Un vínculo positivo entre dos nodos denota una relación positiva (amistad, alianza, citas) y un vínculo negativo entre dos nodos denota una relación negativa (odio, ira). Estos gráficos de redes sociales pueden ser utilizados para predecir la evolución futura de la gráfica. En ellos, existe el concepto de ciclos «equilibrados» y «desequilibrados». Un ciclo de equilibrio se define como aquél donde el producto de todos los signos son positivos. Los gráficos balanceados representan un grupo de personas con muy poca probabilidad de cambio en sus opiniones sobre las otras personas en el grupo. Los gráficos desequilibrados representan un grupo de individuo que es muy probable que cambie sus opiniones sobre los otros en su grupo. Por ejemplo, en un grupo de 3 personas (A, B y C) donde A y B tienen una relación positiva, B y C tienen una relación positiva, pero C y A tienen una relación negativa, es un ciclo de desequilibrio. Este grupo es muy probable que se transforme en un ciclo equilibrado, tal que la B sólo tiene una buena relación con A, y tanto A como B tienen una relación negativa con C. Al utilizar el concepto de ciclos balanceados y desbalanceados, puede predecirse la evolución de la evolución de un grafo de red social.

Un estudio ha descubierto que la felicidad tiende a correlacionarse en redes sociales. Cuando una persona es feliz, los amigos cercanos tienen una probabilidad un 25 por ciento mayor de ser también felices. Además, las personas en el centro de una red social tienden a ser más feliz en el futuro que aquellos situados en la periferia. En las redes estudiadas se observaron tanto a grupos de personas felices como a grupos de personas infelices, con un alcance de tres grados de separación: se asoció felicidad de una persona con el nivel de felicidad de los amigos de los amigos de sus amigos.[16]

Algunos investigadores han sugerido que las redes sociales humanas pueden tener una base genética.[17] Utilizando una muestra de mellizos del National Longitudinal Study of Adolescent Health, han encontrado que el in-degree (número de veces que una persona es nombrada como amigo o amiga), la transitividad (la probabilidad de que dos amigos sean amigos de un tercero), y la intermediación y centralidad (el número de lazos en la red que pasan a través de una persona dada) son significativamente hereditarios. Los modelos existentes de formación de redes no pueden dar cuenta de esta variación intrínseca, por lo que los investigadores proponen un modelo alternativo «Atraer y Presentar», que pueda explicar ese caracter hereditario y muchas otras características de las redes sociales humanas.[18]

El software germinal de las redes sociales parte de la teoría de los seis grados de separación, según la cual toda la gente del planeta está conectada a través de no más de seis personas. De hecho, existe una patente en EEUU conocida como six degrees patent por la que ya han pagado Tribe y LinkedIn. Hay otras muchas patentes que protegen la tecnología para automatizar la creación de redes y las aplicaciones relacionadas con éstas.

Estas redes sociales se basan en la teoría de los seis grados, Seis grados de separación es la teoría de que cualquiera en la Tierra puede estar conectado a cualquier otra persona en el planeta a través de una cadena de conocidos que no tiene más de seis intermediarios. La teoría fue inicialmente propuesta en 1929 por el escritor húngaro Frigyes Karinthy en una corta historia llamada Chains. El concepto está basado en la idea que el número de conocidos crece exponencialmente con el número de enlaces en la cadena, y sólo un pequeño número de enlaces son necesarios para que el conjunto de conocidos se convierta en la población humana entera.

El término red social es acuñado principalmente a los antropólogos ingleses John Barnes y Elizabeth Bott, ya que, para ellos resultaba imprescindible cosiderar lazos externos a los famliares, residenciales o de pertenencia a algún grupo social.[19]

Los fines que han motivado la creación de las llamadas redes sociales son varios, principalmente, es el diseñar un lugar de interacción virtual, en el que millones de personas alrededor del mundo se concentran con diversos intereses en común.

Recogida también en el libro «Six Degrees: The Science of a Connected Age” del sociólogo Duncan Watts, y que asegura que es posible acceder a cualquier persona del planeta en tan solo seis “saltos”.

Según esta Teoría, cada persona conoce de media, entre amigos, familiares y compañeros de trabajo o escuela, a unas 100 personas. Si cada uno de esos amigos o conocidos cercanos se relaciona con otras 100 personas, cualquier individuo puede pasar un recado a 10.000 personas más tan solo pidiendo a un amigo que pase el mensaje a sus amigos.

Estos 10.000 individuos serían contactos de segundo nivel, que un individuo no conoce pero que puede conocer fácilmente pidiendo a sus amigos y familiares que se los presenten, y a los que se suele recurrir para ocupar un puesto de trabajo o realizar una compra. Cuando preguntamos a alguien, por ejemplo, si conoce una secretaria interesada en trabajar estamos tirando de estas redes sociales informales que hacen funcionar nuestra sociedad. Este argumento supone que los 100 amigos de cada persona no son amigos comunes. En la práctica, esto significa que el número de contactos de segundo nivel será sustancialmente menor a 10.000 debido a que es muy usual tener amigos comunes en las redes sociales.

Si esos 10.000 conocen a otros 100, la red ya se ampliaría a 1.000.000 de personas conectadas en un tercer nivel, a 100.000.000 en un cuarto nivel, a 10.000.000.000 en un quinto nivel y a 1.000.000.000.000 en un sexto nivel. En seis pasos, y con las tecnologías disponibles, se podría enviar un mensaje a cualquier lugar individuo del planeta.

Evidentemente cuanto más pasos haya que dar, más lejana será la conexión entre dos individuos y más difícil la comunicación. Internet, sin embargo, ha eliminado algunas de esas barreras creando verdaderas redes sociales mundiales, especialmente en segmento concreto de profesionales, artistas, etc.

En la década de los 50, Ithiel de Sola Pool (MIT) y Manfred Kochen (IBM) se propusieron demostrar la teoría matemáticamente. Aunque eran capaces de enunciar la cuestión «dado un conjunto de N personas, ¿cual es la probabilidad de que cada miembro de estos N estén conectados con otro miembro vía k1, k2, k3,…, kn enlaces?», después de veinte años todavía eran incapaces de resolver el problema a su propia satisfacción.

En 1967, el psicólogo estadounidense Stanley Milgram ideó una nueva manera de probar la Teoría, que él llamó «el problema del pequeño mundo». El experimento del mundo pequeño de Milgram consistió en la selección al azar de varias personas del medio oeste estadounidense para que enviaran tarjetas postales a un extraño situado en Massachusetts, situado a varios miles de millas de distancia. Los remitentes conocían el nombre del destinatario, su ocupación y la localización aproximada. Se les indicó que enviaran el paquete a una persona que ellos conocieran directamente y que pensaran que fuera la que más probabilidades tendría, de todos sus amigos, de conocer directamente al destinatario. Esta persona tendría que hacer lo mismo y así sucesivamente hasta que el paquete fuera entregado personalmente a su destinatario final.

Aunque los participantes esperaban que la cadena incluyera al menos cientos de intermediarios, la entrega de cada paquete solamente llevó, como promedio, entre cinco y siete intermediarios. Los descubrimientos de Milgram fueron publicados en «Psychology Today» e inspiraron la frase seis grados de separación.

En The social software weblog han agrupado 120 sitios web en 10 categorías y QuickBase también ha elaborado un completo cuadro sobre redes sociales en Internet.

El origen de las redes sociales se remonta, al menos, a 1995, cuando Randy Conrads crea el sitio web classmates.com. Con esta red social se pretende que la gente pueda recuperar o mantener el contacto con antiguos compañeros del colegio, instituto, universidad, etcétera.

En 2002 comienzan a aparecer sitios web promocionando las redes de círculos de amigos en línea cuando el término se empleaba para describir las relaciones en las comunidades virtuales, y se hizo popular en 2003 con la llegada de sitios tales como MySpace o Xing. Hay más de 200 sitios de redes sociales, aunque Friendster ha sido uno de los que mejor ha sabido emplear la técnica del círculo de amigos.[cita requerida] La popularidad de estos sitios creció rápidamente y grandes compañías han entrado en el espacio de las redes sociales en Internet. Por ejemplo, Google lanzó Orkut el 22 de enero de 2004. Otros buscadores como KaZaZZ! y Yahoo crearon redes sociales en 2005.

En estas comunidades, un número inicial de participantes envían mensajes a miembros de su propia red social invitándoles a unirse al sitio. Los nuevos participantes repiten el proceso, creciendo el número total de miembros y los enlaces de la red. Los sitios ofrecen características como actualización automática de la libreta de direcciones, perfiles visibles, la capacidad de crear nuevos enlaces mediante servicios de presentación y otras maneras de conexión social en línea. Las redes sociales también pueden crearse en torno a las relaciones comerciales.

Las herramientas informáticas para potenciar la eficacia de las redes sociales online («software social»), operan en tres ámbitos, «las 3 Cs», de forma cruzada:

- Comunicación (nos ayudan a poner en común conocimientos).

- Comunidad (nos ayudan a encontrar e integrar comunidades).

- Cooperación (nos ayudan a hacer cosas juntos).

El establecimiento combinado de contactos (blended networking) es una aproximación a la red social que combina elementos en línea y del mundo real para crear una mezcla. Una red social de personas es combinada si se establece mediante eventos cara a cara y una comunidad en línea. Los dos elementos de la mezcla se complementan el uno al otro. Vea también computación social.

Las redes sociales continúan avanzando en Internet a pasos agigantados, especialmente dentro de lo que se ha denominado Web 2.0 y Web 3.0, y dentro de ellas, cabe destacar un nuevo fenómeno que pretende ayudar al usuario en sus compras en Internet: las redes sociales de compras. Las redes sociales de compras tratan de convertirse en un lugar de consulta y compra. Un espacio en el que los usuarios pueden consultar todas las dudas que tienen sobre los productos en los que están interesados, leer opiniones y escribirlas, votar a sus productos favoritos, conocer gente con sus mismas aficiones y, por supuesto, comprar ese producto en las tiendas más importantes con un solo clic. Esta tendencia tiene nombre, se llama Shopping 2.0.

No hay unanimidad entre los autores a la hora de proponer una tipología concreta. En algunos sitios se aplica la misma tipología que en su día se utilizó para los portales, dividirlos en horizontales y verticales:

- Horizontales: buscan proveer herramientas para la interrelación en general: Facebook, Google+, Hi5, Bebo .

- Verticales por tipo de usuario: dirigidos a un público específico, por ejemplo, profesionales Linkedin, amantes de los gatos MyCatSpace, etc

- Verticales por tipo de actividad: los que promueven una actividad particular. Videos YouTube, Microbloggin Twitter, compras, etc.

Un lazo puede ser llamado conector si su eliminación causa que los puntos que conecta se transformen en componentes distintos de un grafo.

Medidas de la importancia de un nodo dentro de una red, dependiendo de la ubicación dentro de ésta. Ejemplos de medidas de centralidad son la centralidad de grado, la cercanía, la intermediación y la centralidad de vector propio.

La diferencia entre el número de enlaces para cada nodo, dividido entre la cantidad máxima posible de diferencias. Una red centralizada tendrá muchos de sus vínculos dispersos alrededor de uno o unos cuantos puntos nodales, mientras que una red descentralizada es aquella en la que hay poca variación entre el número de enlaces de cada nodo posee.

Una medida de la probabilidad de que dos personas vinculadas a un nodo se asocien a sí mismos. Un coeficiente de agrupación más alto indica un mayor «exclusivismo».

Cohesión

El grado en que los actores se conectan directamente entre sí por vínculos cohesivos. Los grupos se identifican como ‘cliques’ si cada individuo está vinculado directamente con con cada uno de los otros, ‘círculos sociales’ si hay menos rigor en el contacto directo y este es inmpreciso, o bloques de cohesión estructural si se requiere la precisión.[20]

(Nivel individual) Densidad

El grado de relaciones de un demandado de conocerse unos a otros / proporción de lazos entre las mencione de un individuo. La densidad de la red, o densidad global, es la proporción de vínculos en una red en relación con el total de vínculos posibles (redes escasas versus densas)

Flujo de centralidad de intermediación

El grado en que un nodo contribuye a la suma del flujo máximo entre todos los pares de nodos (excluyendo ese nodo).

Véase también

- Análisis de redes

- Servicio de red social

- Redes sociales de internet

- Clique

- Comunidades de práctica

- Comunidad virtual

- Gestión del conocimiento

- Ley de Metcalfe

- Software social

- Dinámica de grupos

- Sistema complejo

Referencias

- ↑ Linton Freeman, The Development of Social Network Analysis. Vancouver: Empirical Press, 2006.

- ↑ Wellman, Barry and S.D. Berkowitz, eds., 1988. Social Structures: A Network Approach. Cambridge: Cambridge University Press.

- ↑ Hansen, William B. and Reese, Eric L. 2009. Network Genie User Manual. Greensboro, NC: Tanglewood Research.

- ↑ Freeman, Linton. 2006. The Development of Social Network Analysis. Vancouver: Empirical Pres, 2006; Wellman, Barry and S.D. Berkowitz, eds., 1988. Social Structures: A Network Approach. Cambridge: Cambridge University Press.

- ↑ Scott, John. 1991. Social Network Analysis. London: Sage.

- ↑ Wasserman, Stanley, and Faust, Katherine. 1994. Social Network Analysis: Methods and Applications. Cambridge: Cambridge University Press.

- ↑ The Development of Social Network Analysis Vancouver: Empirical Press.

- ↑ A.R. Radcliffe-Brown, «On Social Structure,» Journal of the Royal Anthropological Institute: 70 (1940): 1-12.

- ↑ [Nadel, SF. 1957. The Theory of Social Structure. London: Cohen and West.

- ↑ The Networked Individual: A Profile of Barry Wellman. [1]

- ↑ Mark Granovetter, «Introduction for the French Reader,» Sociologica 2 (2007): 1-8; Wellman, Barry. 1988. «Structural Analysis: From Method and Metaphor to Theory and Substance.» Pp. 19-61 in Social Structures: A Network Approach, edited by Barry Wellman and S.D. Berkowitz. Cambridge: Cambridge University Press.

- ↑ Mark Granovetter, «Introduction for the French Reader,» Sociologica 2 (2007): 1-8; Wellman, Barry. 1988. «Structural Analysis: From Method and Metaphor to Theory and Substance.» Pp. 19-61 in Social Structures: A Network Approach, edited by Barry Wellman and S.D. Berkowitz. Cambridge: Cambridge University Press. (see also Scott, 2000 and Freeman, 2004).

- ↑ Barry Wellman, Wenhong Chen and Dong Weizhen. Networking Guanxi. Pp. 221-41 in Social Connections in China: Institutions, Culture and the Changing Nature of Guanxi, edited by Thomas Gold, Douglas Guthrie and David Wank. Cambridge University Press, 2002.

- ↑ Could It Be A Big World After All?: Judith Kleinfeld article.

- ↑ Six Degrees: The Science of a Connected Age, Duncan Watts.

- ↑ James H. Fowler and Nicholas A. Christakis. 2008. «Dynamic spread of happiness in a large social network: longitudinal analysis over 20 years in the Framingham Heart Study.» British Medical Journal. December 4, 2008: doi:10.1136/bmj.a2338. Para aquellos que no puedan ver el original: Happiness: It Really is Contagious Retrieved December 5, 2008.

- ↑ «Genes and the Friends You Make», Wall Street Journal, 27 de enero de 2009.

- ↑ Fowler, J. H. (10 de febrero de 2009). «Model of Genetic Variation in Human Social Networks» (PDF). Proceedings of the National Academy of Sciences 106 (6): pp. 1720–1724. doi:. http://jhfowler.ucsd.edu/genes_and_social_networks.pdf.

- ↑ Medios de comunicación y solidaridad: reflexiones entorno a la (des)articulicación social, Ed. Universitat Jaume I, España, 2006

- ↑ Cohesive.blocking R es el programa para calcular la cohesión estructural según el algoritmo de Moody-White (2003). Ese wiki provee numerosos ejemplos y un tutorial para utilizar R.

Lecturas adicionales

- Barnes, J. A. «Class and Committees in a Norwegian Island Parish», Human Relations 7:39-58

- Berkowitz, Stephen D. 1982. An Introduction to Structural Analysis: The Network Approach to Social Research. Toronto: Butterworth. ISBN 0-409-81362-1

- Brandes, Ulrik, and Thomas Erlebach (Eds.). 2005. Network Analysis: Methodological Foundations Berlin, Heidelberg: Springer-Verlag.

- Breiger, Ronald L. 2004. «The Analysis of Social Networks.» Pp. 505–526 in Handbook of Data Analysis, edited by Melissa Hardy and Alan Bryman. London: Sage Publications. ISBN 0-7619-6652-8 Excerpts in pdf format

- Burt, Ronald S. (1992). Structural Holes: The Structure of Competition. Cambridge, MA: Harvard University Press. ISBN 0-674-84372-X

- (en italiano) Casaleggio, Davide (2008). TU SEI RETE. La Rivoluzione del business, del marketing e della politica attraverso le reti sociali. ISBN 88-901826-5-2

- Carrington, Peter J., John Scott and Stanley Wasserman (Eds.). 2005. Models and Methods in Social Network Analysis. New York: Cambridge University Press. ISBN 978-0-521-80959-7

- Christakis, Nicholas and James H. Fowler «The Spread of Obesity in a Large Social Network Over 32 Years,» New England Journal of Medicine 357 (4): 370-379 (26 July 2007)

- Coz Fernandez, Jose Ramón and Fojón Chamorro, Enrique (2010). «Modulo de Madurez para la Privacidad de una Red Social Virtual». ISBN 978-1-4457-2017-3

- Doreian, Patrick, Vladimir Batagelj, and Anuska Ferligoj. (2005). Generalized Blockmodeling. Cambridge: Cambridge University Press. ISBN 0-521-84085-6

- Freeman, Linton C. (2004) The Development of Social Network Analysis: A Study in the Sociology of Science. Vancouver: Empirical Press. ISBN 1-59457-714-5

- Hill, R. and Dunbar, R. 2002. «Social Network Size in Humans.» Human Nature, Vol. 14, No. 1, pp. 53–72.

- Jackson, Matthew O. (2003). «A Strategic Model of Social and Economic Networks». Journal of Economic Theory 71: pp. 44–74. doi:. pdf

- Huisman, M. and Van Duijn, M. A. J. (2005). Software for Social Network Analysis. In P J. Carrington, J. Scott, & S. Wasserman (Editors), Models and Methods in Social Network Analysis (pp. 270–316). New York: Cambridge University Press. ISBN 978-0-521-80959-7

- Krebs, Valdis (2006) Social Network Analysis, A Brief Introduction. (Includes a list of recent SNA applications Web Reference.)

- Ligon, Ethan; Schechter, Laura, «The Value of Social Networks in rural Paraguay», University of California, Berkeley, Seminar, March 25, 2009 , Department of Agricultural & Resource Economics, College of Natural Resources, University of California, Berkeley

- Lin, Nan, Ronald S. Burt and Karen Cook, eds. (2001). Social Capital: Theory and Research. New York: Aldine de Gruyter. ISBN 0-202-30643-7

- Mullins, Nicholas. 1973. Theories and Theory Groups in Contemporary American Sociology. New York: Harper and Row. ISBN 0-06-044649-8

- Müller-Prothmann, Tobias (2006): Leveraging Knowledge Communication for Innovation. Framework, Methods and Applications of Social Network Analysis in Research and Development, Frankfurt a. M. et al.: Peter Lang, ISBN 0-8204-9889-0.

- Manski, Charles F. (2000). «Economic Analysis of Social Interactions». Journal of Economic Perspectives 14: pp. 115–36. [2] via JSTOR

- Moody, James, and Douglas R. White (2003). «Structural Cohesion and Embeddedness: A Hierarchical Concept of Social Groups.» American Sociological Review 68(1):103-127. [3]

- Newman, Mark (2003). «The Structure and Function of Complex Networks». SIAM Review 56: pp. 167–256. doi:. pdf

- Nohria, Nitin and Robert Eccles (1992). Networks in Organizations. second ed. Boston: Harvard Business Press. ISBN 0-87584-324-7

- Nooy, Wouter d., A. Mrvar and Vladimir Batagelj. (2005). Exploratory Social Network Analysis with Pajek. Cambridge: Cambridge University Press. ISBN 0-521-84173-9

- Scott, John. (2000). Social Network Analysis: A Handbook. 2nd Ed. Newberry Park, CA: Sage. ISBN 0-7619-6338-3

- Sethi, Arjun. (2008). Valuation of Social Networking [4]

- Tilly, Charles. (2005). Identities, Boundaries, and Social Ties. Boulder, CO: Paradigm press. ISBN 1-59451-131-4

- Valente, Thomas W. (1995). Network Models of the Diffusion of Innovations. Cresskill, NJ: Hampton Press. ISBN 1-881303-21-7

- Wasserman, Stanley, & Faust, Katherine. (1994). Social Network Analysis: Methods and Applications. Cambridge: Cambridge University Press. ISBN 0-521-38269-6

- Watkins, Susan Cott. (2003). «Social Networks.» Pp. 909–910 in Encyclopedia of Population. rev. ed. Edited by Paul George Demeny and Geoffrey McNicoll. New York: Macmillan Reference. ISBN 0-02-865677-6

- Watts, Duncan J. (2003). Small Worlds: The Dynamics of Networks between Order and Randomness. Princeton: Princeton University Press. ISBN 0-691-11704-7

- Watts, Duncan J. (2004). Six Degrees: The Science of a Connected Age. W. W. Norton & Company. ISBN 0-393-32542-3

- Wellman, Barry (1998). Networks in the Global Village: Life in Contemporary Communities. Boulder, CO: Westview Press. ISBN 0-8133-1150-0

- Wellman, Barry. 2001. «Physical Place and Cyber-Place: Changing Portals and the Rise of Networked Individualism.» International Journal for Urban and Regional Research 25 (2): 227-52.

- Wellman, Barry and Berkowitz, Stephen D. (1988). Social Structures: A Network Approach. Cambridge: Cambridge University Press. ISBN 0-521-24441-2

- Weng, M. (2007). A Multimedia Social-Networking Community for Mobile Devices Interactive Telecommunications Program, Tisch School of the Arts/ New York University

- White, Harrison, Scott Boorman and Ronald Breiger. 1976. «Social Structure from Multiple Networks: I Blockmodels of Roles and Positions.» American Journal of Sociology 81: 730-80.

Enlaces externos

Wikilibros alberga un libro o manual sobre Análisis de Redes Sociales.

Wikilibros alberga un libro o manual sobre Análisis de Redes Sociales.- Center for Computational Analysis of Social and Organizational Systems (CASOS) at Carnegie Mellon

- NetLab at the University of Toronto, studies the intersection of social, communication, information and computing networks

- Building networks for learning– A guide to on-line resources on strengthening social networking.

- Recomendaciones de seguridad en redes sociales– guía de la Oficina de seguridad del Internauta.

- ¿Cumplen las redes sociales los compromisos de privacidad con los menores?

Fuente: Wikipedia, Marzo 2013.

—————————————————————-

¿Cuánto vale una casa en Mosul?

junio 13, 2014

¿Cuánto vale una casa en Mosul?

La pregunta pude sonar extraña, pero no carente de interés. Mosul es hoy una ciudad en retirada:

“Medio millón de personas huyeron de Mosul y otras localidades norteñas ante el avance de los jihadistas y la respuesta de las tropas gubernamentales, que bombardearon algunas posiciones rebeldes.” La Nación, 13/06/14.

Este simple ejemplo pone de relieve la importancia de juzgar las inversiones con una perspectiva amplia, considerando períodos largos y no subestimando los riesgos. Similares preguntas podrían plantearse con relación a un Depósito bancario, una Cartera de Acciones o Bonos, un Mutual Fund o un Hedge Fund.

El valor y la calidad de una inversión depende del contexto, del lugar donde está radicada, del marco jurídico y de la estabilidad institucional.

Estos son algunos de los temas que evaluamos -en forma introductoria- en el Seminario gratuito “Cómo iniciar un Plan de Inversión eficaz” y profundizamos en el libro Manual de Economía Personal.

Si quiere saber más y acceder a esta valiosa información escriba a: economiapersonal@gmail.com

Exodo en Mosul, junio 2014.

————————————–

Mosul es una ciudad localizada en el norte de Irak, ubicada al este del río Tigris y distante aproximadamente unos 396 km de Bagdad, la capital del país. Mosul es la tercera ciudad más grande de Irak, después de la capital y de Basora.

A pocos kilómetros de Mosul se encuentra el yacimiento de Tell Hassuna, que data aproximadamente del 6000 a. C.

La población de la provincia es fundamentalmente árabe pero la mayoría de los habitantes de la ciudad son asirios. En 1987 tenía 664.221 habitantes, pasando a 1.739.800 en 2002. En ella murieron miles de personas durante la guerra de Kuwait.

Fuente: Wikipedia, 2014.

————————————–

Los yihadistas que tomaron Mosul penetran en la ciudad iraquí de Tikrit.

Por Ángeles Espinosa.

· Los milicianos del EIIL prosiguen su ofensiva que ha causado medio millón de desplazados

· Los yihadistas conquistan la principal ciudad del norte de Irak

· La población del norte de Irak abandona sus casas

Envalentonados por el éxito militar y mediático de la toma de Mosul el martes, los extremistas suníes del Ejército Islámico de Irak y el Levante (EIIL) seguían avanzando el miércoles. Milicianos de ese grupo y otros asociados se hicieron con el control de Tikrit, la capital de la provincia de Saladino, donde también hostigaban una importante refinería. Mientras, las tropas de la vecina región autónoma del Kurdistán se mantenían en alerta ante la posibilidad de que el Gobierno central pida su cooperación para recuperar Mosul, una decisión que sin duda tendría un elevado coste político para Nuri al Maliki, justo cuando intenta asegurarse un tercer mandato como primer ministro.

“Con el permiso de Dios, no cesaremos en esta serie de benditas conquistas hasta que Él cumpla sus promesas o nosotros muramos”, aseguraba un comunicado del EIIL publicado en un foro yihadista y traducido por Efe.

No son solo palabras. A media tarde del miércoles, fuentes oficiales admitían que los insurgentes habían logrado invadir varios barrios de la ciudad de Tikrit y, según la agencia iraquí NINA, quemaron la sede de la gobernación tras haberla tomado sin resistencia. Situada a 150 kilómetros de Bagdad y famosa porque en sus cercanías nació el depuesto dictador Sadam Husein, Tikrit es la capital de la provincia de Saladino, donde los yihadistas han instalado sus banderas negras en otras localidades más pequeñas, e intentaban hacerse con la refinería de Baiji, tras garantizar a los 250 policías que la vigilan que podrán irse si deponen las armas.

Muchas familias que permanecen en sus casas no tienen ni electricidad ni agua corriente.

Un poco más al este, en la provincia de Kirkuk, los rebeldes ejecutaron sumariamente a 15 miembros de las fuerzas de seguridad, en las zonas que conquistaron la víspera, informa France Presse. También se supo que en Mosul retienen a 80 ciudadanos turcos. Medio centenar de ellos, incluido el cónsul, su familia y otros diplomáticos, fueron secuestrados en el consulado general de ese país; el resto son camioneros, ha confirmado el miércoles el Ministerio de Exteriores turco. Pero la mayoría de la población no espera a ver cuáles son las intenciones de esos extremistas que aspiran a refundar el Califato entre el Tigris y el Mediterráneo, y cuya brutalidad en Siria, donde también operan, les ha granjeado la condena de Al Qaeda, organización en la que se inspiraron.

“Medio millón de personas han abandonado sus hogares en Mosul o sus alrededores”, informa la Organización Internacional para las Migraciones (OIM). Es una cuarta parte de los habitantes de la ciudad. Según esa organización, también se ha producido “un número importante de víctimas entre los civiles”, aunque nadie ha facilitado datos al respecto. Además, escasean los víveres y el agua potable, y los yihadistas han prohibido el uso de coches. Quienes huyen tienen que hacerlo a pie.

Claves del Estado Islámico de Irak y Levante

Tiene de 3.000 a 5.000 milicianos en sus filas, tanto árabes como extranjeros. El profesor del Kings College de Londres, Peter Neumann, estima que el 80% de los milicianos extranjeros en Siria se ha sumado al EIIL.

Es una organización vinculada a Al Qaeda que se creó en abril de 2013.

El grupo es principalmente activo en Irak y Siria.

Abu Bakr al-Baghdadi es el líder principal.

Lucha contra lo que definen como el monopolio del poder por parte del primer ministro iraquí, el chií Nuri Al Maliki.

Los combatientes del EIIL profesan la rama suní del Islam.

En Irak, tienen el control de las ciudades de Ramadi, Faluya y Mosul y en Siria tienen una fuerte presencia en tres provincias.

Su fuente de financiación es desconocida.

La ofensiva, incluidos dos atentados suicidas en Bagdad que causaron una veintena de muertos, constituye un órdago al Gobierno de Al Maliki, incapaz de frenar el renacer de la insurgencia suní que él mismo ayudó a apaciguar en 2008. Desde principios de este año, y en gran medida por su gestión de las relaciones con esa comunidad, los yihadistas han logrado hacerse con el control de Faluya y de buena parte de Ramadi, a 60 y 100 kilómetros al oeste de Bagdad, respectivamente.

Ahora, con el país escapándosele de las manos, Al Maliki se enfrenta a una difícil tesitura. Ni el estado de emergencia que el jueves va a debatir el Parlamento, ni la leva de milicias populares que propuso el martes resultan suficientes para revertir esa tendencia. Sin el respaldo del Ejército estadounidense que se retiró de Irak a finales de 2011 y con unas fuerzas armadas que no dan más de sí (y cuya motivación ha quedado en evidencia en Mosul), solo le queda recurrir a los kurdos.

“Habrá una estrecha cooperación entre Bagdad y el Gobierno regional del Kurdistán para trabajar juntos y expulsar a esos combatientes extranjeros”, aseguró ayer el ministro iraquí de Exteriores, Hoshyar Zebari, en Atenas, donde acudía a una reunión entre la UE y la Liga Árabe. Zebari, que es kurdo, enunciaba lo que muchos tenían en la cabeza.

Sin embargo la entrada en escena de los Peshmerga, como se conoce a las tropas kurdas, no es tan sencilla. Por un lado, Al Maliki aún no ha logrado formar un nuevo Gobierno tras las elecciones del pasado abril y carece por tanto de aliados con los que respaldar esa decisión. Por otro, los kurdos, que a pesar de sus diferencias actúan como un bloque compacto en Bagdad, compiten con los chiíes por la influencia política, en especial en el control de los pozos petrolíferos de Kirkuk. ¿Qué precio van a pedir a cambio de su ayuda?

De momento, todo son especulaciones. Aunque sobre el terreno hay indicaciones de coordinación ocasional entre el Ejército iraquí y los Peshmerga, la petición no parece haberse cursado todavía. No puede tardar. Como advirtió Zebari, “la respuesta tiene que ser rápida; no se les puede dejar atrincherarse durante mucho tiempo”.

Fuente: El País, 11/06/14.

Etiquetas: EIIL, Yihad, Irak, Al Qaeda, Guerrillas, Terrorismo islamista, Oriente próximo, Asia, Grupos terroristas, Guerra, Terrorismo, Conflictos.

Los malos empleados aman su trabajo

junio 13, 2014

Los malos empleados aman su trabajo

Por Lauren Weber

Los mejores empleados de una empresa también deberían ser los más felices y entusiasmados, pero no siempre es así.

Un nuevo estudio indica que, en 42% de las empresas, los empleados con bajo desempeño de hecho reportan sentirse más entusiasmados —más motivados y con más probabilidad de disfrutar del trabajo en su organización, por ejemplo— que los que tienen un desempeño mediano y alto.

El estudio sugiere que muchas organizaciones no están logrando que sus empleados se responsabilicen por su trabajo, lo que permite que los peores trabajadores no hagan mucho esfuerzo, afirma Mark Murphy, presidente ejecutivo de Leadership IQ, la firma de consultoría con sede en Atlanta que realizó la encuesta.

«Quienes tienen un bajo desempeño suelen terminar con los trabajos más fáciles porque los gerentes no les piden mucho», sostiene, así que soportan menos estrés y están más satisfechos con sus vidas laborales día a día.

En tanto, los trabajadores dedicados y concienzudos terminan quedándose en la oficina hasta tarde, corrigiendo el trabajo de quienes tienen bajo desempeño y asegurándose de que los clientes o compradores estén satisfechos. Este patrón genera frustración y desapego entre los de mejor desempeño, y quizás termina llevándolos a buscar trabajo en otro lado. «Se sienten estresados y subestimados, y esto comienza a socavar la confianza de los empleados de desempeño alto en que la organización es una meritocracia», dice Murphy.

Para remediar la situación, los gerentes deberían hablar con franqueza con los empleados de desempeño alto y medio, para descubrir qué frustraciones podrían llevarlos a buscar nuevas oportunidades. También deberían averiguar qué podría motivarlos a quedarse, agrega.

Para averiguar esto, Leadership IQ analizó datos de 207 empresas que llevaban un registro detallado tanto de evaluaciones de desempeño como de encuestas de dedicación.

En el 58% restante de las organizaciones encuestadas, los que tenían un alto desempeño eran los más metidos en el trabajo, o las puntuaciones de dedicación eran parecidas entre todos los empleados. En los casos menos habituales, señala Murphy, los empleados de desempeño medio eran los más entusiasmados con el trabajo. Ese segmento de la fuerza laboral —los empleados que no son ni superestrellas ni holgazanes— suele ser ignorado por los gerentes, dice.

Leadership IQ analizó también la dinámica específica de una empresa, una firma de servicios tecnológicos con 1.000 empleados, donde los de menor desempeño reportaron altos niveles de dedicación. El estudio descubrió que, en una escala de 7 puntos, los de bajo desempeño otorgaron un puntaje de 5,99 a la afirmación «Estoy motivado para dar 100% de mi esfuerzo cuando estoy en el trabajo». Los de alto rendimiento otorgaron un puntaje de 5,36 y la puntuación de los de desempeño medio fue de 5,32, el nivel más bajo.

Los empleados de bajo desempeño también registraban una mayor probabilidad que los otros dos grupos de recomendar a su empresa como una «gran organización donde trabajar». Y en muchos casos, ni siquiera se dieron cuenta de que tenían bajo desempeño. Cuando se les preguntó si los empleados de la empresa «mantienen todos los mismos estándares», los trabajadores de bajo desempeño contestaron con mucha más frecuencia que estaban de acuerdo con el enunciado en comparación con sus colegas de mejor desempeño.

Fuente: The Wall Street Journal, 28/03/13.

The 2014 NUL top 100

junio 12, 2014

The 2014 NUL top 100.

By Warren S. Hersch, Emily Holbrook.

Statistics can tell a lot, not only about the financial health of companies, but also how they stack up against one another. In this annual feature, we take the pulse of 100 top-ranking life and health insurers when measured against four key metrics: net investment income, total enrollment (health lines only), policyholder surplus and net premiums written.

The report card on the last of these, of particular interest to life insurance professionals, reveals a shake up in the ranks, with a top three insurer in 2012 displacing the formerly number one carrier in 2013. Hence, UnitedHealth Group overtook WellPoint last year in the health segment (all lines); Jackson National surpassed Prudential Financial in the annuities space (individual and group); and Prudential nudged aside MetLife in life insurance net premiums (excepting credit life).

In two market segments — life/ accident & health (except credit); and life (supplemental & other) — the top insurer of 2012 maintained the top position in 2013. The companies: UnitedHealth Group Inc. and TIAA-CREF, respectively.

A comparison of 2012 and 2013 tables also reveals significant variations in net premiums written for individual companies. A prime example is Prudential Financial, which last year garnered $19.2 billion in net premiums, down from the $61.1 billion recorded in 2012.

How to explain so significant a decline? A Prudential spokesperson attributed the dip to two factors: (1) a one-time bump from $30 billion of premium income generated by pension risk transfer transactions concluded with General Motors and Verizon in 2012; and (2) a decrease in gross sales of variable annuities ($11.447 billion in 2013 versus $19.977 billion in 2012).

While these items are “almost certainly the main drivers” for the premium decline, the spokesperson cautions that Prudential cannot take responsibility for the accuracy of data provided by a third party.

The source of the stats: SNL Financial, which bases its figures on the insurers’ own filings with the National Association of Insurance Commissioners. SNL Financial’s proprietary database — to which NU and LifeHealthPro have privileged access — standardizes financial data using the life and health insurance industries’ financial parameters, terminology and performance metrics. The company data is also aligned over time to enable easy comparison of different periods.

With this as background, read on. See how your carriers measure up against the competition. You may be surprised!

See:

Evolución matemática de los juegos de azar durante el siglo XIX

junio 12, 2014

La Estadística y la Teoría de la Probabilidad en el Fortalecimiento de los Juegos de Azar:

¿Qué ocurría con la evolución de los juegos de azar durante el siglo XIX, campo primigenio en el cual había surgido la Teoría de la Probabilidad que paulatinamente se había extendido y alcanzado un desarrollo tan impresionante en todas las áreas de la ciencia?

Durante ese siglo prosperaron inicialmente los casinos que se inauguraron en los balnearios alemanes cercanos a los paisajes alpinos de la vertiente del río Rin (Wiesbaden, Baden‑Baden, Bad Homburg, Spa, Saxon‑les‑Bains, etc.), también florecieron numerosas casas de juego en el Estado de Louisiana antes de que comenzara la persecución puritana de los ciudadanos contra esa actividad pecaminosa que luego se propagó hacia otros pueblos de Estados Unidos a través del rió Mississippi, después surgieron los lujosos casinos de la Riviera Francesa como el de Monte Carlo a la cabeza del mundo por mucho tiempo, también se consolidaron los exclusivos clubes de juego para caballeros y las apuestas hípicas en el Reino Unido, florecieron los garitos y los Círculos Privados de juego en la alegre París convertida en una «ciudad‑espectáculo» después de su renovación urbanística concluida bajo el mando del Barón Haussmann, así como proliferaron los garitos en otras acogedoras ciudades francesas, y finalmente también crecieron los rústicos casinos a la americana (el famoso Saloon) durante el proceso de la colonización del Lejano Oeste.

Fundamentación matemática de los juegos de azar durante el siglo XIX.

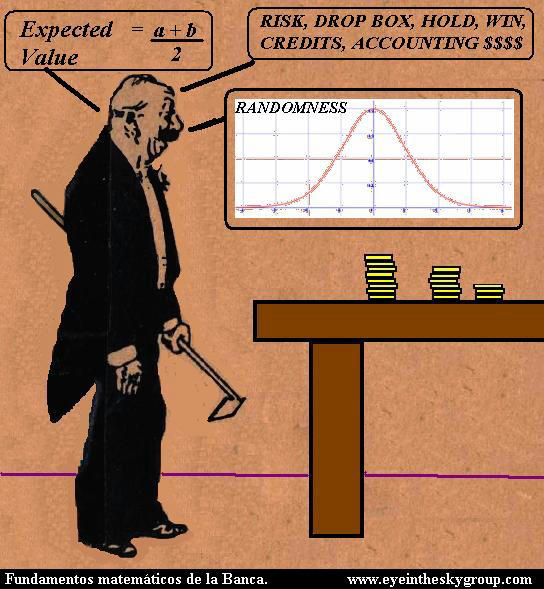

Los flâneur del siglo XIX, es decir, los consumidores del ocio de la Modernidad, esto era todo lo que veían que ocurría ante sus ojos, pero tal vez muy pocos de ellos imaginaban que detrás de la fachada de los clubes, de las casas de juego, de las ventanillas de recepción de apuestas, de los garitos y de los casinos, el funcionamiento del negocio estaba dictado solamente por los últimos avances de la Teoría de la Probabilidad combinada con los aportes de la Estadística como herramienta de medición de los hechos inciertos o aleatorios. En efecto, en aquel tiempo los empresarios del ocio veían los juegos de azar simplemente como un «buen negocio comercial», que sólo es rentable si desde un comienzo le garantiza a la Banca la expectativa de obtener económicamente un cuantificable Valor Esperado (Expected Value) que constituye la Ventaja Matemática a su favor (House Edge), además de que tal rentabilidad sólo se puede concretar si siempre se garantiza un comportamiento impredecible del juego y si sólo se le ofrece al apostador opciones de triunfo «no equitativas» y desiguales frente a las reales opciones de triunfo de la Banca.

Estos primeros empresarios de los casinos, como los famosos hermanos Blanc que dirigieron el casino de Bad Homburg o el de Monte Carlo, eran gente que conocía del comercio, de la especulación financiera en las bolsas y en los bancos, de los criterios económicos aplicables a los negocios de alto riesgo, y por eso estas personas eran seguidoras de los últimos avances matemáticos y estadísticos ocurridos en el campo actuarial y de los seguros que eran una actividad comercial en la que el lucro se obtenía a partir de explotar las expectativas de ganancia o de pérdida en torno de la fortuita ocurrencia o no ocurrencia de ciertos siniestros (naufragios de barcos, deterioro de mercancías, incendios de fábricas, fallecimientos, robos, etc.), es decir, los empresarios de los casinos aplicaron en la administración de su negocio de los juegos de azar muchos de los criterios económicos y matemáticos que regían en el campo de los seguros que era el tipo de negocio más semejante a su actividad, y por eso ellos eran amplios conocedores de conceptos tales como la Teoría de la Ruina, la Pérdida Máxima Probable, el Cálculo del Riesgo Esperado, el Cálculo de las Reservas Disponibles, etc.

Estos primeros empresarios profesionales de los casinos para la adecuada administración de sus negocios del ocio también se asesoraban de importantes matemáticos pagándoles jugosos honorarios, y eran seguidores asiduos de las discusiones y las publicaciones sobre temáticas de probabilidad y estadística producidas por los sabios de su tiempo, por las asociaciones científicas, por las agremiaciones de contables o por los profesores de las universidades de Cambridge, Harvard, Oxford, la Sorbona, Turín, Berlín, etc. Además, tomando como referente el modelo de la Distribución Normal de la probabilidad ampliamente desarrollado por Laplace, Gauss, Poisson o Chebyshev, estos empresarios de los casinos sabían que en cualquier juego de azar, entre más jugadas se realicen, lo más probable es que las apariciones aleatorias de los resultados esperados se concentrarán dentro de ciertos límites en torno de un número ideal de apariciones, es decir, estadísticamente se prevé que los juegos de azar tienen un comportamiento más o menos regular que se puede proyectar previamente mediante el cálculo de probabilidades, comportamiento dentro del cual es poco probable que un resultado específico llegue a aparecer una cantidad excesiva de veces superior a las previstas, hasta el punto de volverse «predecible» a los ojos de los jugadores en contra de los intereses económicos de la Banca. Los empresarios que administraron los primeros grandes casinos le apostaban a la ocurrencia de esa forma de distribución de la probabilidad, le apostaban a que siempre el juego se comportaría aleatoriamente arrojando resultados que aunque en cada jugada son impredecibles, en todo caso globalmente se enmarcan dentro de unos límites más o menos previsibles desde el punto de vista estadístico, y por tanto, si en la mayoría de las ocasiones esos límites se dan, entonces se puede prever que al final la Banca siempre hará efectiva su ventaja matemática sobre los jugadores obteniendo importantes ingresos sobre todo el dinero que fue apostado por ellos.

Todo este conocimiento matemático, estadístico, contable y económico fue aplicado por los empresarios de los casinos en la creación de los nuevos juegos de azar, en la formulación de las reglas aplicables a cada juego, en el diseño de los tapetes de las mesas, en la selección precisa de las únicas opciones a las cuales les pueden apostar los jugadores, en el establecimiento de los montos de los premios que pueden ser pagados, en la fijación de los topes mínimos y máximos de las apuestas que se pueden admitir en cada mesa, etc. Se puede afirmar que, paradójicamente, desde el siglo XIX en las mesas de los juegos de azar de los casinos «nada ocurre al azar», porque los nuevos juegos de azar de la Modernidad no surgieron por generación espontánea ni por tradición cultural ni por caridad para agradarle a los consumidores del ocio, sino que surgieron como parte del engranaje de un gran negocio basado en la explotación de la ventaja matemática (House Edge) que conscientemente se establece a favor de la Banca en cada juego ofrecido al público.

En síntesis, desde el siglo XIX en una mesa de juego de un casino todo está debidamente calculado y planeado, para que desde el mismo momento en que el jugador coloque su apuesta sobre el tapete, las probabilidades y la estadística indiquen que esa apuesta muy probablemente deberá generar un flujo de rentabilidad a favor de las arcas de la Banca. Incluso la recaudación de este flujo rentable de dinero fue perfeccionada y comenzó a operar «automáticamente» gracias al ingeniero norteamericano Charles Fey, cuando basado en los diseños de las máquinas calculadoras, las cajas registradoras, los organillos de manivela, etc., inventó en 1897 la denominada «Máquina Tragamonedas» (Slot Machine), novedoso aparato que no sólo inauguró la gran época en que el comportamiento aleatorio de los juegos de azar comenzó a ser simulado mediante artilugios mecánicos, sino que además a la postre permitió que los empresarios de los casinos tuvieran una mayor seguridad acerca de la expectativa de obtener la recaudación de un porcentaje fijo de rentabilidad sobre el funcionamiento diario de tales máquinas.

Fortalecimiento de las Creencias Especulativas de los Apostadores respecto de los Juegos de Azar:

¿Qué hacían los jugadores y los apostadores del siglo XIX mientras todo lo anterior ocurría en la evolución matemática de los juegos de azar y del negocio de los casinos?

Al respecto un gran porcentaje de los jugadores posiblemente eran hábiles tahúres muy tramposos, que preferían aquellos juegos en los que tenían acceso a la manipulación directa de las cartas o de los dados, o preferían juegos en los que podían actuar en colusión con otros jugadores para así poder realizar todo tipo de timos y trampas contra los contrincantes ingenuos, únicas vías que encontraban seguras para la obtención de ganancias en los juegos de azar.

Muchos otros jugadores, fieles a la noble filosofía consumista del flâneur, consideraban impropio y poco caballeroso pensar en el dinero perdido en los juegos de azar o siquiera expresar cualquier emoción ante el anhelo de ganar una fortuna a través de ese medio: se jugaba, luego se ganaba o se perdía, pero siempre se aceptaban los resultados del azar con gallardía y caballerosidad.

Otros jugadores, menos dóciles a someterse pasivamente al imperio del azar, quizá aplicaban algunos análisis combinatorios muy simples para calcular sus expectativas de triunfo o para elegir las opciones a las que se les debía apostar.

Un creciente porcentaje de jugadores creían a pie juntillas en la falacia de la «Ley del Equilibrio Cósmico» que necesariamente se debe producir en la cantidad de apariciones de los resultados opuestos de un juego de azar entre más jugadas ocurran, falacia que desde los tiempos de D’Alembert inspiró a muchos apostadores a crear diversos sistemas de apuestas supuestamente infalibles, aplicables en mayor medida al Trente‑et‑Quarante o la ruleta, sistemas absurdos basados realmente en simples martingalas y en progresiones en el incremento o en el descenso de la cantidad apostada en cada jugada, tales como la Gran Martingala, la Pequeña Martingala, el sistema Labouchere, la Progresión de Wrangler, el sistema Philiberte, el sistema Fitzroy, el sistema Tiers et Tout, el sistema Montant Belge, el sistema Paroli, etc.

Otros más, tal vez habían escuchado que la estadística era una ciencia que trabajaba de la mano con el cálculo de probabilidades para el análisis del comportamiento de los eventos aleatorios, pero lo único que ellos en verdad sabían sobre la aplicación de la estadística era recolectar unos pocos resultados aparecidos en algún juego de azar y comenzar a apostarle a los resultados que a primera vista parecían «más dominantes» o «más salidores» en el grupo analizado, sin emplear ningún procedimiento matemático serio para verificar si esos resultados presuntamente dominantes o salidores en verdad representaban una «desviación significativa» en el comportamiento aleatorio del juego o si solamente se enmarcaban dentro de los límites previsibles del azar.

Solamente hasta 1873 se conoció de la legendaria hazaña del ingeniero inglés Joseph Hobson Jagger (1830−1892), quien al parecer usó las técnicas de muestreo, de análisis estadístico y de cálculo de probabilidades para descubrir unas fuertes tendencias en una de las ruletas del casino de Monte Carlo, descubrimiento que según se dice le permitió amasar una gran fortuna al apostarle a los números que más probabilidades tenían de aparecer. Después de esta hazaña se conoció de un grupo de jugadores italianos que hacia 1880 también aplicaron las técnicas de la estadística y del cálculo de probabilidades para amasar una gran fortuna nuevamente en las ruletas desviadas de Monte Carlo, y posteriormente durante varias décadas no se volvió a conocer ninguna noticia, anécdota, sistema o libro que hablara a profundidad, con detalles y con ejemplos prácticos, sobre la manera de aplicar de forma conjunta la Estadística y la Teoría de la Probabilidad a concretos juegos de azar para amasar fortunas.

Resulta curioso que durante el siglo XIX los empresarios que administraron los casinos usaron a plenitud todos los elementos de la Estadística y de la Teoría de la Probabilidad para perfeccionar la ventaja matemática establecida en los juegos de azar y protegerse contra el riesgo, contra la probabilidad de ruina, contra las desviaciones inusuales en la aparición de los resultados aleatorios, contra la falta de reservas económicas, etc.; mientras que la mayoría de los jugadores se quedaron estancados en el uso precario del análisis combinatorio o en la creencia en la inmutable Ley del Equilibrio Cósmico que fue defendida por D’Alembert quizá en un momento de desvarío. En otras palabras, absurdamente para enfrentarse a los juegos de azar de la Modernidad los jugadores no estaban empleando las mismas herramientas matemáticas, estadísticas y del cálculo de probabilidades que usaron los empresarios para lograr el perfeccionamiento de la ventaja matemática establecida en tales juegos.

La culpa tal vez no era de los jugadores, sino de la ausencia de fuentes de información especializadas y serias en la aplicación de la Estadística y de la Teoría de la Probabilidad a los juegos de azar. En efecto, si uno analiza las grandes obras sobre estadística y probabilidad del siglo XIX escritas por verdaderos genios matemáticos de la talla de Laplace, Gauss, Poisson, Quetelet o Chebyshev, encuentra que estos sabios para poder explicar los conceptos básicos usados en sus obras acuden inicialmente a ejemplos muy simples basados en el lanzamiento de monedas, el lanzamiento de dados, la extracción aleatoria de cartas de un mazo, la extracción aleatoria de balotas de una urna, el análisis del Problema de los Puntos, etc., pero luego estos sabios se elevan a las alturas intelectuales y se adentran en la axiomatización de los conceptos explicados ligando su aplicación a la solución de problemas más trascendentales que merecían toda su atención, tales como el desciframiento de las órbitas de los planetas, la forma como se comporta la luz, el cálculo de la trayectoria de los planetoides, el cálculo de la resistencia de los metales usados en la fabricación de las mercancías, el cálculo del grado de error cometido en una observación, el desvío esperado en el comportamiento de una variable en un experimento de laboratorio, el cálculo esperado en el crecimiento de la población, el cálculo de la ocurrencia de posibles siniestros asegurados, etc. En las obras de estos grandes autores matemáticos no hay referencias a la manera práctica de aplicar y sacar provecho del Muestreo Estadístico, la Distribución Normal, la Varianza, la Desviación Típica o los Niveles de Confianza a juegos de azar concretos como el Baccarat, el Trente‑et‑Quarante, la ruleta francesa, el Chuck‑a‑Luck, las loterías, etc.

Lo anterior no significa que durante el siglo XIX no se hayan escrito obras de literatura especializada sobre los juegos de azar, pues de hecho se escribieron muchas, mereciendo mención especial por su popularidad las siguientes:

An exposure of the arts and miseries of gambling, (1843). Escrita por Jonathan H. Green y publicada en Filadelfia.

Traité du Trente‑Quarante contenant des analyses et des faits pratiques du plus haut intéret suivis d’une collection de plus de 40.000 coups de banque, (1853). Escrita por G. Grégoire y publicada en París.

Nouveau manuel complet des jeux de calcul et de hasard ou Nouvelle Académie des Jeux, (1853). Escrita por Lasserre, Lebrun y Leroy, y publicada en París.

Routledge’s Whist Player’s Handbook, (1854). Escrita por N. Routledge y publicada en Londres.

Jeux de la Roulette et du Trente et Quarante, Méthode, (1880). Escrita por Menaldo y publicada en Niza.

Le jeu public et Monaco, (1882). Escrita por Le Docteur Prompt, y publicada en Paris.

Les grands jeux: Roulette, Trente & Quarante, Baccarat, Bourse; (1885). Escrita por Pierre Boissier y publicada en París.

Il Giuoco del Lotto, (1886). Escrita por M. de Ciutiis y publicada en Nápoles.

Une lune de miel à Monte Carlo, (1887). Escrita por Adolphe Belot y publicada en Paris.

Girotechnie ou la description scientifique de la roulette, (1890). Escrita por el doctor C. Surville y publicada en Niza.

Montecarlo occulto, Montecarlo palese, (1899). Escrita por Barone York y publicada en Turín.

Sin embargo, estas obras, y muchas otras de su mismo estilo escritas y publicadas en el siglo XIX, se dedican principalmente a explicar las reglas aplicables a populares juegos de azar como el veintiuno, el póquer, el whist, la ruleta, el Trente‑et‑Quarante, el baccarat, etc., pero no ofrecen un análisis serio de esos juegos que se fundamente en el cálculo de probabilidades o en el estudio estadístico de los resultados aleatorios. Realmente esas obras se limitan a proponerle al lector la aplicación de una serie de sistemas de colocación de apuestas, martingalas y progresiones que generalmente están basadas en las «falacias del jugador», sin ofrecer una verdadera prueba matemática de su efectividad frente a la Banca, todo lo cual es adobado además con una serie de anécdotas, especulaciones, recomendaciones y observaciones basadas sólo en la experiencia personal del autor de cada obra. En verdad es muy difícil creer que esas obras tienen un auténtico carácter científico, debido a la gran cantidad de especulaciones y suposiciones que emplean en la fundamentación de los diversos temas que tratan.

¿Por qué los grandes genios matemáticos y científicos del siglo XIX no aprovechaban sus conocimientos para escribir obras especializadas y serias sobre los juegos de azar?

Quizá muchos matemáticos, contables, ingenieros y científicos de esa época, que habían sido consultados por los mismos empresarios administradores de los casinos que perfeccionaron los modernos juegos de azar para así garantizar las ganancias de la Banca, sabían que si los juegos de azar tienen un comportamiento aleatorio que estadísticamente es próximo al modelo de la Distribución Normal, entonces no vale la pena gastar las neuronas tratando de formular sistemas matemáticos de apuestas que supuestamente prometen obtener ganancias exorbitantes en los juegos de azar, cuando realmente en muy contados casos el jugador verá ocurrir una inusitada racha favorable que se desvié significativamente más allá del comportamiento promedio del juego, lo cual tiene una probabilidad de ocurrencia siempre muy baja.

Tal vez por eso tampoco resulta extraño que desde el siglo XIX muchos jugadores hayan terminado parapetados en la lectura de obras que hablan de milagrosos sistemas de apuestas que sólo se basan en las falacias, o que, en el peor de los casos, al intentar encontrar sistemas infalibles de apuestas que puedan vencer a la Banca, hayan terminado por revivir las viejas creencias místicas sobre la «Diosa Fortuna» (el uso de talismanes, patas de conejo, fe ciega en las corazonadas, etc.) que son propias de aquella remota época pagana y oscurantista en que aún en los juegos de azar no regía la ventaja matemática perfeccionada a favor de la Banca.

Bibliografía consultada:

HALD, Anders. A history of mathematical statistics from 1750 to 1930. John Wiley & Sons, New York, 1998.

KILBY, J. y FOX, J. Casino operations management. John Wiley & Sons, New York, 2005.

KOYRE, Alexandre. Estudio de historia del pensamiento científico. Editorial Siglo XXI, Ciudad de México, 1978.

STIGLER, Stephen. The history of statistics: the measurement of uncertainty before 1900.Belknap Press/Harvard University Press, 1990.

WIKIPEDIA. Consulta de los términos: Expected Value; Gambler’s Fallacy; Gambling; History of Statistics; House Edge; Wagering Business.

Fuente: http://www.eyeintheskygroup.com, 2014.

———————–

Más información relacionada:

Juego Seguro on line en España

La industria de las apuestas continúa su escalada

Cómo hacer un backup efectivo

junio 12, 2014

No hay nada más viejo que el backup de hoy

Por Ariel Torres

Haciendo un poco de orden encuentro una caja. La caja contiene fotos de mis antepasados. Casi ninguna expone fechas o nombres, por lo que, a estas alturas, carecen de significado. Una imagen vale más que mil palabras, siempre y cuando tenga un epígrafe de 60 caracteres. Al menos, si se trata de una foto documental.

Es obvio que conozco esa caja y su contenido desde hace mucho. Mi pensamiento no recala en los epígrafes; en cambio, medito sobre lo que han perdurado esas imágenes. En algunos casos, calculo, cerca de un siglo. Entonces giro la cabeza y miro la pila de discos externos que descansa sobre mi mesa de trabajo. No puedo sino reírme. Me imagino algún descendiente que trata de acceder esas unidades dentro de 80 o 90 años. Bueno, sí, es humor geek, lo admito. Pero estamos todos en la misma. Sacamos 2500 fotos durante un viaje y después los JPG quedan por ahí, en el disco duro, en una carpeta. A lo sumo, las tagueamos y copiamos a un disco externo. ¿Qué tan perdurables son esos documentos?

Nos guste o no, nuestra capacidad de producir documentos digitales es inversamente proporcional a nuestra certeza de seguir conservándolos en el futuro. Una invisible e infinitesimal debilidad estructural en el disco rígido, y adiós, miles de fotos, textos y videos invaluables, irreemplazables, se evaporarán, habiendo existido siempre en un limbo digital intangible.

Es que no importa, como me han dicho en más de una oportunidad, que los registros en papel y acetato tampoco sean para siempre. No es el punto. El punto es que los registros digitales son microscópicos y están sellados en una caja negra. Carecen de la franqueza del papel y el acetato, cuyo deterioro podemos detectar a tiempo y, de alguna forma, rescatar el contenido. En el caso de los discos duros existe la tecnología SMART ( Self-Monitoring, Analysis, and Reporting Technology ), que avisa cuando la unidad tiene algún problema de salud, pero he visto fallar dos discos duros de forma catastrófica, de un día para el otro, sin el menor aviso de SMART.

Más aún -anoto en el margen-, hoy es imposible para la mayoría de las personas acceder a los contenidos de un simple diskette, que dejaron de usarse hace tan sólo una década (Dell anunció en febrero de 2003 que sus equipos hogareños ya no tendrían lectora de diskettes). El papel y el acetato no necesitan baterías, sistemas operativos, lectores ni formatos especiales.

No, no me interesa volver al laboratorio fotográfico ni retomar la máquina de escribir, pero es menester reducir los riesgos de la burbuja documental en la que vivimos. ¿Cómo? Con un backup. (Y, nota en el margen también, usando formatos de archivo públicos y abiertos, porque de nada sirve un backup que dentro de 25 años no puede decodificarse.)