¿Hacia dónde va la Inteligencia de Negocios?

mayo 1, 2020

Cinco tendencias que están marcando la evolución de la Analítica y el Business Intelligence

Las empresas que atraviesan un proceso de transformación digital adoptan en prácticamente todos los casos nuevas tecnologías que las ayudan a avanzar y agilizar procesos. Entre ellas hay en muchos casos una o varias ramas de la Inteligencia Artificial. Como la Analítica o el Business Intelligence, dos piezas de gran importancia para que las empresas consigan extraer información útil y valiosa de los datos que manejan y puedan aplicarla en sus procesos. Tanto, que según Gartner, muchos directivos y empresas centradas en lo digital han convertido a ambas tecnologías en dos de sus principales prioridades de inversión.

Estas dos tecnologías, al igual que el resto de ramas de la Inteligencia Artificial, avanzan de manera constante, para lo que se apoyan en diversas tendencias que dan forma a su evolución. De ellas, las cinco más punteras en la actualidad son las siguientes:

1 – Analítica aumentada

La analítica aumentada emplea el machine learning para automatizar la preparación de datos, el descubrimiento de información, la ciencia de datos, el desarrollo de modelos de machine learning y la compartición de información para un amplio rango de usuarios profesionales, trabajadores y científicos de datos «civiles».

A medida que vaya madurando, la analítica aumentada se convertirá en una función clave de las plataformas de analítica moderna. Proporcionará análisis a cualquier miembro de una empresa en menos tiempo, y también con menos requisitos para los usuarios con experiencia, y con menos sesgo interpretativo que los enfoques manuales actuales.

2 – Cultura digital

El desarrollo de una cultura digital eficaz puede ser el primer y más importante paso en una empresa de cara a abordar sus procesos de transformación digital. Cualquier organización que intenta obtener valor de sus datos y está en pleno proceso de transformación digital debe centrarse en el desarrollo de una formación en datos. Según los analistas de Gartner, la formación de datos tendrá impacto en todos los empleados, ya que se convertirá no solo en una habilidad de empresa, sino en una que será crítica para la vida.

En relación con esto, la preocupación por el peso cada vez mayor de la Inteligencia Artificial y la sociedad digital, pero también de las fake news, tanto las organizaciones como los gobiernos están interesándose cada vez más por la ética digital.

Los líderes en datos y analítica deberían patrocinar debates sobre ética digital para asegurarse de que la información y la tecnología se usan de manera ética para conseguir y mantener la confianza de empleados, clientes y socios. Y parece que, según Gartner, es cada vez más importante. Así, según sus datos, para 2023, el 60% de organizaciones con más de 20 científicos de datos necesitarán un código de conducta profesional que incorpore un uso ético de los datos y la analítica.

3 – Analítica de las relaciones

La emergencia de la analítica de relaciones pone de manifiesto el uso creciente de los grafos, la ubicación y las técnicas de analítica social, con el objetivo de comprender cómo están conectadas las distintas entidades de interés, como la gente, los lugares y las cosas.

El análisis de datos desestructurados y cambiantes puede proporcionar a los usuarios información y contexto en una red, y datos más exhaustivos que mejoren la precisión de las predicciones y la toma de decisiones.

4 – Inteligencia de decisión

Los líderes en datos y analítica trabajan con grandes cantidades de datos de ecosistemas que están en evolución constante. Por lo tanto necesitan utilizar una multitud de técnicas para gestionar los datos de forma eficaz.

Lo impredecible de los modelos de decisión actuales viene a menudo de una incapacidad para capturar de manera adecuada o tener en cuenta ciertos factores de incertidumbre relacionada con el comportamiento de modelos en un contexto de empresa. La inteligencia de decisión proporciona un framework que aúna técnicas tradicionales y avanzadas para diseñar, modelar, alinear, ejecutar, controlar y afinar modelos de decisión.

5 – Operatividad y escalado

La cantidad de casos de uso en el núcleo de una empresa, en sus áreas relacionadas y más allá es ingente. Cada vez más más gente que quiere interactuar con los datos, y cada vez más interacciones y procesos necesitan analítica para la automatización y el escalado.

Los servicios de analítica y los algoritmos se activan cada vez con más frecuencia cuándo y donde se necesitan. Ya sea para justificar el siguiente gran paso estratégico o para optimizar millones de transacciones, las herramientas de analítica y los datos que las alimentan están en espacios en los que hasta ahora era raro encontrarlos.

Fuente: muycomputerpro.com, 2019

___________________________________________________________________

Analítica de grafos: El valor de las relaciones

Con los avances en Big Data y Machine Learning en los últimos años, el análisis y modelado de datos se está convirtiendo en algo cada vez más importante, convirtiendo el rol de Data Scientist en un perfil cada vez más relevante y solicitado.

Pero, ¿qué tiene que ver esto con la analítica de grafos?

Los grafos son una estructura de datos que aporta mucho valor tanto en áreas científicas y de investigación (biología, sociología, etc), como en áreas de negocio (estudios de mercado, detección de fraude, etc), permitiendo modelar la información visualmente de una forma mucho más “real”.

Por esta razón, la analítica de grafos se ha convertido en una habilidad más que todo analista de datos debería aprender.

¿Cómo realizar un análisis?

Aunque visualmente un grafo pequeño es fácil de entender, la volumetría de los datos y la complejidad de las propiedades y de las relaciones puede dificultar mucho su interpretación. Por esta razón, es importante definir qué es lo que se quiere medir o analizar y utilizar la metodología y los algoritmos correctos para obtener conclusiones.

Dentro de la teoría de grafos, en función de lo que se pretenda obtener, se pueden realizar los siguientes tipos de análisis:

- Path analysis: analiza las características de las rutas entre dos nodos, por ejemplo, para conocer la distancia mínima que hay entre ellos. Existen muchos casos de uso dónde este análisis es muy útil, uno de los más comunes sería utilizarlo para conocer los pasos que ha realizado un usuario desde que accede a una web hasta que compra un producto, pero también se utiliza para temas más complejos, como analizar patrones de comportamiento que llevan a una persona a cometer un fraude.

- Connectivity analysis: se utiliza para comprobar la “fuerza” de las relaciones, permitiendo detectar relaciones débiles o vulnerables entre dos nodos. Un caso de uso para este tipo de análisis sería detectar cuellos de botella en la comunicación dentro de una red de ordenadores.

- Community analysis: este método de análisis se basa en la distancia y densidad del grafo para detectar comunidades de nodos, de forma que cada comunidad contenga nodos con características comunes o similares.

- Centrality analysis: permite conocer la relevancia que tienen los nodos dentro del grafo, es decir, analiza la influencia que tiene un nodo. El ejemplo más común sería detectar las páginas web más visitadas, sin embargo, tiene usos más atractivos como detectar las personas más influyentes en las redes sociales.

La centralidad dentro de un grafo se puede calcular en función de distintas medidas. La siguiente imagen muestra los resultados de centralidad utilizando diferentes medidas sobre el mismo grafo:

- Subgraph isomorphism: analiza el grafo para obtener patrones estructurales dentro del mismo, permitiendo averiguar qué patrones son los más repetidos. La detección de patrones es un método muy utilizado para la detección de fraude.

- Graph Embedding: se trata de una técnica que permite interpretar los nodos como vectores y así poder entrenar y ejecutar modelos predictivos de Machine Learning sobre el grafo. Por lo general, el uso de modelos ML sobre grafos es complicado debido a la forma en la que están estructurados los datos, sin embargo, técnicas como Graph Embedding facilitan su uso al transformar las estructuras de nodos en vectores.

La analítica de grafos es una rama dentro del análisis de datos que permite visualizar la información de forma más clara, y que se está utilizando en numerosas disciplinas, como detección de fraude, marketing, investigación, etc. a fin de revelar rasgos y tendencias ocultos en los datos. Por esta razón, se está convirtiendo en una habilidad muy cotizada en personas con perfil de analista.

La analítica de grafos basada en proyectos Big Data y complementada con tecnología como Machine Learning y Deep Learning proporciona a los analistas un mapa del comportamiento facilitando y simplificando los procesos de investigación.

___________________________________________________________________

Luchando contra el fraude: “El roadmap de la detección”

Hace unas semanas tuve la oportunidad de participar como ponente en el “III Foro Anual de Gestión de Siniestros y Fraude” organizado por INESE en la que pude explicar cómo la analítica de grafos puede ayudar en la detección de fraude aportando nuevas perspectivas de análisis. Veremos cómo las compañías aseguradoras pueden emprender el “roadmap de la detección” desde la tramitación manual a la analítica de grafos pasando por la implementación de algoritmos de Machine Learning. Estas son las fases del “Roadmap de la detección”:

Matrices de fraude o automatización de reglas de negocio

La mayor parte de las compañías disponen de una identificación clara de las reglas de negocio que determinan el riesgo de un determinado siniestro en función de la experiencia de negocio adquirida en los últimos años.

De esta forma, las compañías determinan el riesgo de un siniestro en base a las condiciones establecidas en el producto contratado (periodos de carencia, exclusiones, etc…) o bien, en función de la experiencia ganada con siniestros sospechosos en el pasado, identificando una serie de reglas que permiten obtener un indicador de riesgo en base al cumplimiento de dichas reglas.

Algunas compañías han pasado de la identificación de las reglas de negocio o matriz de fraude, a una automatización de la misma basada en productos de mercado o bien, en una implementación ad-hoc para sus sistemas de tramitación de siniestros.

- La automatización de la matriz de fraude aporta una serie de ventajas:

- Permite que el modo de tramitación de todo el departamento se base en las mismas reglas evitando la interpretación subjetiva de las reglas.

- Evita el pago de siniestros que no cumplen con las condiciones del producto o sus exclusiones de un modo automático.

- Aporta un nivel de riesgo de fraude a aquellos siniestros que cumplen con unas características que han sido determinadas en base a la experiencia de la compañía o a la experiencia global del sector.

Las matrices de fraude son un elemento altamente eficaz, de hecho la mayor parte de las compañías dispone de mecanismos de automatización de las mismas. Sin embargo, el volumen de información que disponen las compañías está creciendo exponencialmente y por lo tanto deberíamos ser capaces de responder a la siguiente pregunta: ¿Existen otros datos distintos a los tratados en la matriz que pueden determinar el riesgo de un siniestro? Para poder responder a esta pregunta, necesitamos entrar en el siguiente paso del roadmap (hoja de ruta):

Machine Learning

Si bien las técnicas de machine learning existen de manera previa a la irrupción del Big Data, es cierto que esta nueva tendencia permite que estas técnicas sean más eficaces gracias a la capacidad que disponemos para usar la totalidad de los datos para el entrenamiento de los modelos en lugar de muestreos más pequeños.

Teniendo en cuenta esta premisa, es fácil imaginar oportunidades de mejora en la automatización de la matriz de fraude si además de contar con la información proveniente de los sistemas de tramitación, pudiéramos mezclar esa información con la información que proviene de los centros de atención al usuario, correos electrónicos, la historia del cliente en la compañía y otros elementos.

Disponer de la capacidad de mezclar toda esta información aporta unas ventajas claras a la hora de determinar el riesgo de fraude de un determinado siniestro, sin embargo, hay que tener en cuenta multitud de aspectos esenciales para tener éxito en este tipo de aproximaciones:

- ¿Dispongo de la suficiente calidad en la información de mis sistemas?

- ¿Puedo mejorar dicha calidad de un modo automatizado?

- ¿Cómo puedo acceder a la información de todos los sistemas sin alterar su rutina de funcionamiento?

- ¿Cómo seleccionamos las variables más relevantes?

- ¿Cómo se aborda un proyecto de Machine Learning?

- ¿Cómo reduzco el número de falsos positivos?

Aunque intentaré responder a estas preguntas en posteriores artículos, lo que podemos determinar es que la aplicación de las técnicas de Machine Learning aportan de nuevo una serie de ventajas adicionales:

- Aumenta el rango de búsqueda de los siniestros con riesgo de fraude: La selección de nuevas variables puede determinar nuevos condicionantes hasta ahora desconocidos.

- Automatiza la identificación del riesgo a partir de la aplicación de estos modelos.

- Aporta un nuevo indicador de fraude en base a la predicción del riesgo a través de dichos modelos.

- Permite la no repetición de fraude que hayamos detectado en el pasado.

- Puede reducir el número de falsos positivos de las matrices de fraude.

Esta serie de ventajas pueden aportar una gran diferencia con respecto a la automatización de la matriz de fraude y suponen un gran retorno de inversión para aquellas compañías aseguradoras que invierten en el desarrollo de estos sistemas de detección.

Hasta este momento de la “Hoja de Ruta de la detección” hemos conseguido minimizar el riesgo de reaparición de fraudes para los que tenemos indicios en el histórico de la compañía, sin embargo, ¿Podemos acercarnos un paso adicional en la detección del fraude que nunca hemos detectado en la compañía o que no tenemos consciencia de él? Las siguientes etapas nos permiten acercarnos a la resolución de esta pregunta.

Enriquecimiento de la información

Uno de los aspectos fundamentales para encontrar nuevos indicios de riesgo de fraude es disponer de otros elementos de información distintos a los que disponemos en nuestras organizaciones que puedan enriquecer la información que disponemos de nuestros clientes o del propio siniestro, para ello existen varias catalogaciones de las fuentes de información:

Redes Sociales e Internet: La sociedad ha cambiado de manera radical en los últimos años hacia la digitalización. El uso de redes sociales y blogs, entre otros es una constante en casi todos los rangos de edad poblacionales, lo que supone una gran oportunidad para las compañías si son capaces de recoger parte de esa información para enriquecer sus propios datos.

Fuentes públicas: En los últimos años se han desarrollado multitud de fuentes de libre disposición y que permiten enriquecer la información de nuestra compañía con múltiples indicadores como pueden ser valores socio económicos, valores meteorológicos, geopolíticos, etcétera. Estas fuentes de libre disposición vienen determinadas por las corrientes Open Data que se han ido desarrollando en los últimos años por los gobiernos de todo el mundo; de hecho, España es líder europeo en la puesta a disposición de los ciudadanos de multitud de fuentes de información para el desarrollo de diferentes modelos de negocio.

Fuentes privadas: Existen multitud de recursos que pueden adquirirse a través de diferentes asociaciones o empresas para enriquecer la información de nuestros clientes con un posible riesgo crediticio, patrón de comportamiento, etc. Estas fuentes de información permiten a las compañías enriquecer su información a través de acuerdos interempresa.

Si bien la disposición de estas fuentes de información para enriquecer nuestros datos puede ser un elemento diferencial en la detección de fraude, disponer de esta información no está exento de múltiples cuestiones a considerar:

- ¿Es viable disponer de esta información sin vulnerar la LOPD (Ley Orgánica de Protección de Datos de Carácter Personal)?

- ¿Cuál es la fiabilidad de cada una de las fuentes de información?

- ¿Qué trabajo es necesario para normalizar esta información externa e integrarla en los procesos de tramitación de mi compañía?

- ¿Qué beneficio real me aporta la incorporación de esta fuente?

Analítica de grafos

Uno de los enfoques más creativos a la hora de luchar contra el fraude o determinar el riesgo de un determinado cliente u operación, es conseguir analizar la información desde múltiples perspectivas. En este sentido, la Analítica de Grafos nos permite enfocar la detección de fraude desde un punto de vista completamente distinto al habitual, el enfoque de las relaciones.

Como hemos visto en los anteriores puntos, la mayor parte de las técnicas utilizadas consiste en analizar los datos desde el punto de vista del valor de dichos datos, sin embargo, la Analítica de Grafos nos permite modelar la información desde el punto de vista de cómo se interrelaciona la información. Este nuevo enfoque nos permite identificar nuevos indicios de fraude basándonos en cómo nuestros clientes, nuestros siniestros, nuestros datos, se interrelacionan entre sí.

La Analítica de Grafos o SNA (Social Network Analysis) es una técnica que nos permite modelar cualquier realidad en una red formada por nodos y relaciones como podemos ver en la siguiente figura:

Esta aproximación nos permite acelerar los tiempos de investigación de cada caso, basándonos en que los tramitadores o analistas no tienen que imaginarse un mapa mental del siniestro sino que dichas técnicas nos aportan un enfoque completamente visual de la información.

De otro modo, la Analítica de Grafos aplicada a los datos de una compañía aseguradora nos permite conocer el comportamiento de nuestros clientes en cada uno de los siniestros de la compañía y así identificar nuevos indicios como elementos en común entre diferentes siniestros, aparición de redes organizadas de fraude, detección de secuencias temporales o patrones geográficos. Es decir, dado que el fraude lo cometen personas, utilicemos un modelado de información que nos permita “ver” como se interrelacionan dichas personas.

Pero la Analítica de Grafos no es sólo un modo de visualización o modelado, sino que nos permite la aplicación de diferentes técnicas y algoritmos matemáticos que nos

permiten inferir patrones de comportamiento en el conjunto de nuestros clientes o anomalías que se encuentran en nuestros datos de un modo automatizado.

En mi opinión, la detección de fraude o la determinación del riesgo de un determinado perfil es una tarea realmente compleja y no existen los sistemas infalibles. Sin embargo, la utilización de la Analítica de Grafos junto con el Machine Learning y el enriquecimiento de la información aporta un elemento diferenciador en la lucha contra el fraude y puede generar importantes beneficios para una compañía que decida emprender dicho camino.

Fuente: bites.futurespace.es, 15/11/17.

Más información:

La Inteligencia y sus especialidades en la Sociedad del conocimiento

___________________________________________________________________

.

.

El Tablero de Control en una estrategia de marketing

mayo 1, 2020

El Dashboard en una estrategia de marketing

Por Tristán Elósegui.

[En este artículo se analiza el caso de uso de Dashboards en marketing, esto puede generalizarse a muchas otras áreas en empresas y organizaciones.]

Al hablar de Dashboards o Tableros de Control, inmediatamente pensamos en Analítica digital. Es inevitable, pensamos en datos, Google Analytics,… y si eres un poco más técnico, piensas en etiquetados, Google Tag Manager (GTM), integración de fuentes, Google Data Studio, etc.

Pero en realidad, pienso que deberíamos darle la vuelta al enfoque. Por definición, la Analítica digital es una herramienta de negocio. Representa los ojos y oídos de la estrategia de marketing, y por tanto se debe definir desde el negocio y no desde el departamento de Analítica (con su ayuda, pero no liderado por ellos).

Para explicarlo, os dejo una resumen de mí ponencia en el primer congreso de marketing digital celebrado en Pontevedra (Congreso Flúor).

Para definir correctamente un dashboard, debemos partir de la estrategia de marketing y seleccionar las fuentes de datos y métricas que mejor la representen. Las que mejor nos describan el contexto de nuestra actividad de marketing, y nos permitan tomar las mejores decisiones.

Para entender el papel de un dashboard en una estrategia vamos a ver cinco puntos:

- ¿Qué es un dashboard?

- ¿Cómo se define un cuadro de mando?

- Caso práctico real.

- Consejos para aportar valor con un dashboard de marketing.

- Ejemplos de dashboard.

Pero, empecemos la historia por el principio.

¿Qué es un dashboard?

Me gusta enfocar la definición de dashboard, de dos maneras, mejor dicho de una manera que concluye en la clave de todo:

Es una representación gráfica de las principales métricas de negocio (KPI), y su objetivo es propiciar la toma de decisiones para optimizar la estrategia de la empresa.

Un dashboard de indicadores debe transformar los datos en información y estos en conocimiento para el negocio.

[Obsérvese la similitud con la definición de Inteligencia.]

Esta transformación de los datos nos debe llevar a una mejor Toma de decisiones. Este es el objetivo principal que no debemos perder de vista. Algo que suele pasar con cierta frecuencia en este proceso. Nos centramos tanto en el proceso de creación del Tablero de Control, que tendemos a olvidar que su objetivo es la toma de decisiones y no la acumulación de datos. Pero esta es otra historia.

A todo esto tenemos que añadir un elemento más, ya que la base para la toma de decisiones está en un buen análisis de los datos.

[No debe confundirse el concepto de Tablero de Control (Dashboard) con el de Cuadro de Mando Integral (Balanced Scorecard).]

¿Qué necesitamos para hacer un buen análisis de un dashboard de control?

Pues fundamentalmente dos cosas:

- Visión estratégica de negocio.

- Pilares del análisis de datos.

Visión estratégica de negocio:

- Correcta definición de los objetivos de marketing y de negocio: es lo que nos va a marcar el camino a seguir, lo que va a definir el éxito de nuestro marketing.

- Definición de la macro y micro conversiones: debemos traducir nuestras metas a hechos objetivos medibles en nuestra web, y además ser capaces de asignarlos a cada una de las etapas del proceso de compra de nuestra audiencia.

- Conocer el contexto: en nuestros resultados incluyen muchas variables: mercado, competencia, regulaciones, etc. En ocasiones son tantas, que dejamos de mirar. Pero un buen punto de arranque para entender los porqués de gran parte de las variaciones en los datos, está en la estrategia de marketing y sus acciones planificadas.

Pilares del análisis de datos:

- Personal cualificado: debemos ser capaces de vencer la tentación de pensar que una herramienta de medición nos va a solucionar el problema. La clave del buen análisis está en las personas que lo realizan. Son las que realizan la transformación de los datos en información y esta en conocimiento para la empresa.

Para tenerlo claras las proporciones, se estima que de cada 100 € invertidos en medición, 90 deben ir a personas y 10 a herramientas. - Calidad del dato: nos tenemos que asegurar de que lo datos que estamos analizando se acercan lo máximo a la realidad. Digo lo máximo, porque es normal que en algunas métricas veamos variaciones entre los datos que nos da la herramienta de analítica y los sistemas internos.

Además de tener la tranquilidad de que estamos usando los datos correctos para tomar decisiones, vamos a eliminar las discusiones internas sobre cuál es el dato real y cual no. - Tablero de Control (Dashboard):

- Definición: selección de KPIs y métricas.

- Implementación técnica: configuración de la herramienta de medición, y etiquetado (web y acciones).

- Integración de fuentes en herramienta de cuadro de mandos.

- Definición de la visualización más adecuada.

- Informes y herramientas de análisis adicionales: necesarios para complementar los diferentes niveles de análisis necesarios.

Para realizar un análisis correcto de un dashboard debemos ir de lo global a los específico

El dashboard de métricas debe contar una historia. Nos debe enseñar el camino desde los principales indicadores, a la explicación de la variación del dato.

Además este cuadro de mando no debe contar con más de 10 KPIs (aproximadamente), primero porque no debería haber más y segundo, porque nos complicamos el análisis.

- Objetivos y KPIs de la estrategia.

- Métricas contextuales.

- Fuentes de datos que necesitaremos para componer el dashboard.

- Siguiente paso: seleccionar el tipo de dashboard más adecuado.

Y por último, aconsejo que el Tablero de Control sea una foto fija de la realidad. Existen herramientas de dashboard que permiten profundizar en el análisis y cruzar variables, pero las desaconsejo (al menos en una primera fase). ¿por qué? El tener estas posibilidades nos llevará a invertir tiempo en darle vueltas a los datos, y nos alejará de la toma de decisiones (objetivo principal de todo cuadro de mando).

Un buen dashboard comercial o de marketing es como un semáforo: Nos muestra las luces rojas, amarillas y verdes de nuestra actividad y las decisiones a tomar .

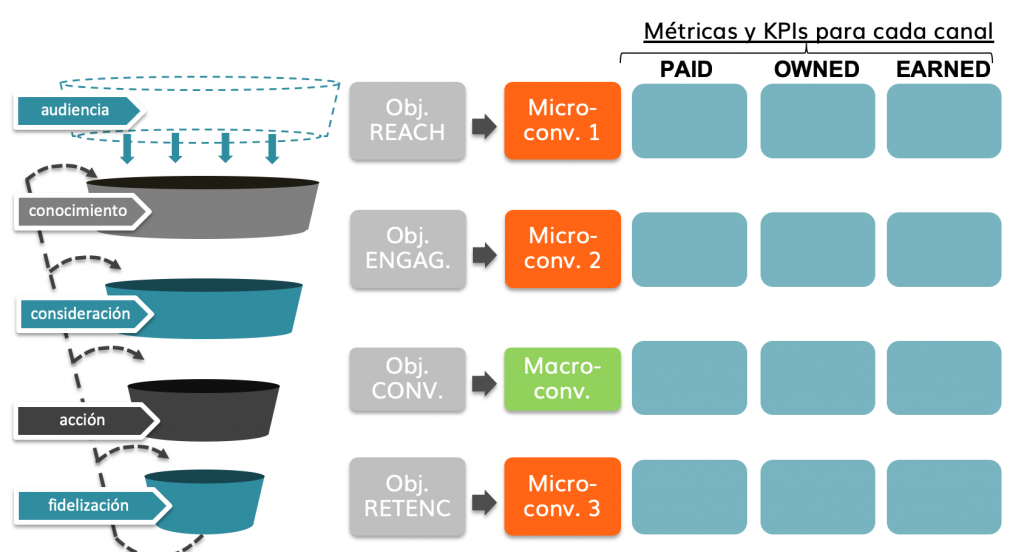

¿Cómo se define un Tablero de Control de marketing?

Para hacerlo debemos partir del planteamiento de nuestra estrategia (ya que es lo que queremos controlar). Cómo ya adelantaba al hablar de las claves de un buen análisis, tenemos que tener muy claros varios puntos:

- Objetivos por etapa del embudo de conversión (purchase funnel).

- Macro y microconversiones: traducción de estos objetivos a métricas que podamos medir en nuestra página web.

- Métricas de contexto, que nos ayudan a entender la aportación de los medios pagados, propios y ganados a la consecución de los objetivos de cada etapa del embudo de marketing.

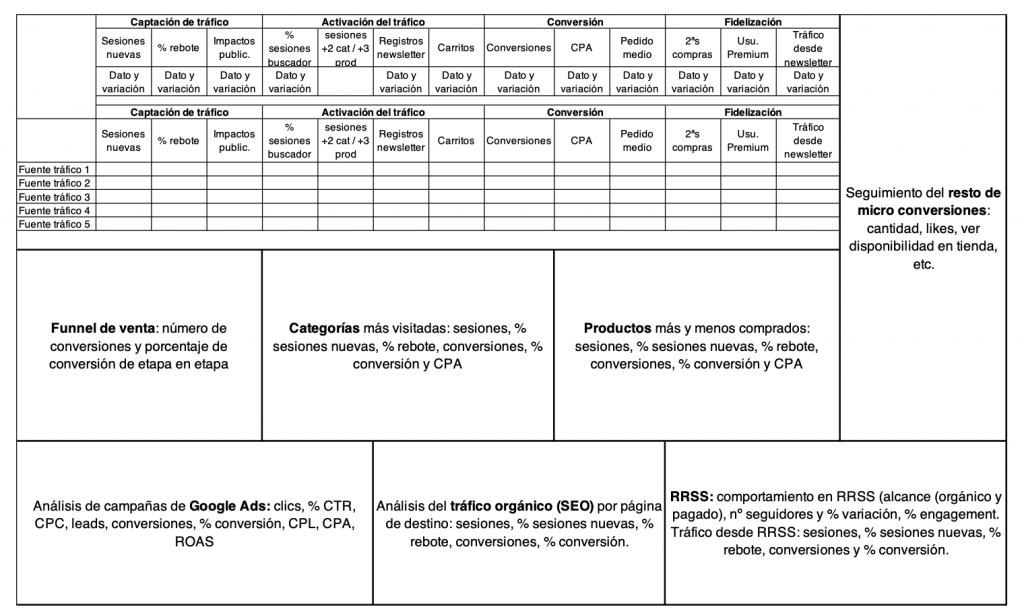

La imagen que os dejo a continuación, os ayudará a estructurar mejor la información y sobre todo a no olvidar métricas importantes.

Definición de macro y micro conversiones – Tristán Elósegui

.

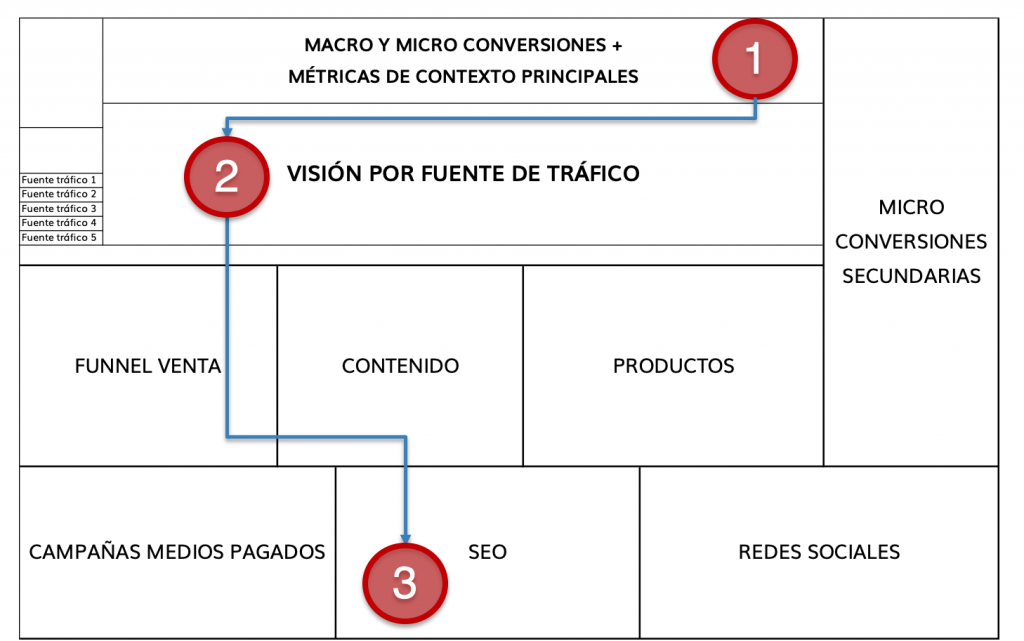

¿Qué tenemos hasta el momento?

- Objetivos y KPIs de la estrategia.

- Métricas contextuales.

- Fuentes de datos que necesitaremos para componer el dashboard.

- Siguiente paso: seleccionar el tipo de dashboard más adecuado.

Con esta información ya podemos hacer la selección de las métricas y definir nuestro dashboard de indicadores en formato borrador.

Borrador Dashboard de marketing – Tristán Elósegui

.

Cómo veis en este ejemplo de dashboard, podemos hacer un seguimiento desde el origen de la variación en las KPI principales, hasta el canal o campaña que las causó. Es decir, hemos definido un cuadro de mando que nos cuenta la “historia” de lo que ha ocurrido en el periodo analizado.

Caso práctico real (PCcomponentes.com):

El proceso real es algo más complejo, pero voy a simplificarlo para facilitar la lectura y comprensión.

NOTA: No tengo relación alguna con PCcomponentes.com, por lo que todo lo que vais a ver a continuación son supuestos que realizo para poder explicaros la definición de un Dashboard de indicadores.

Siguiendo la metodología que os acabo de explicar tendríamos que definir:

- Objetivos: para definir el cuadro de mando vamos a partir de una serie de objetivos por etapa que me he inventado.

- Macro y microconversiones: para definirlas para este ejemplo, vamos a hacerlo por medio de un análisis de las llamadas a la acción de la web. Una vez detectadas las más importantes, vamos a ordenarlas por etapa (normalmente lo haríamos analizando que llamadas a la acción han intervenido en las conversiones obtenidas, pero obviamente no tengo acceso de los datos).

- Representación de estas métricas en nuestro borrador de dashboard de métricas.

A continuación os dejo: el pantallazo de una página de producto, la definición de macro y microconversiones y el borrador de dashboard de control.

PCcomponentes página producto

.

Caso real PCcomponentes – Objetivos y métricas para Dashboard de marketing

.

Propuesta de Dashboard de marketing para PCcomponentes – Tristán Elósegui

Consejos para aportar valor con un Dashboard de marketing

Suponiendo que hemos cumplido con todo lo dicho hasta ahora en la parte estratégica y técnica, mis principales consejos son:

- Visualización correcta: el tablero de control tiene que ser perfectamente entendible por la persona que lo va a analizar y su cliente (ya sea interno o externo).

Recuerda que no se trata de hacer cosas bonitas o espectaculares (aunque ayuden a hacerlo más fácil), si no de tomar decisiones. Por lo tanto, esta debe ser nuestra prioridad. - Correcta selección métricas: además de acertar con las métricas que mejor describen la actividad de marketing, debemos pensar en nuestro cliente ¿qué le interesa? ¿qué métrica reporta a su jefe?

Es la mejor forma de fidelizarle y provocar que cada semana o mes, lo primero que haga sea abrir el dashboard comercial o de marketing que acaba de recibir. - Analiza, no describas: el análisis es lo más importante del cuadro de mando. Describir los datos que estás viendo no aporta valor alguno. Para hacerlo, debes hablar de cuatro cosas:

- ¿Qué ha pasado?

- ¿Por qué ha pasado?

- Recomendaciones basadas en datos.

- Resultados esperados de poner en práctica tus recomendaciones.

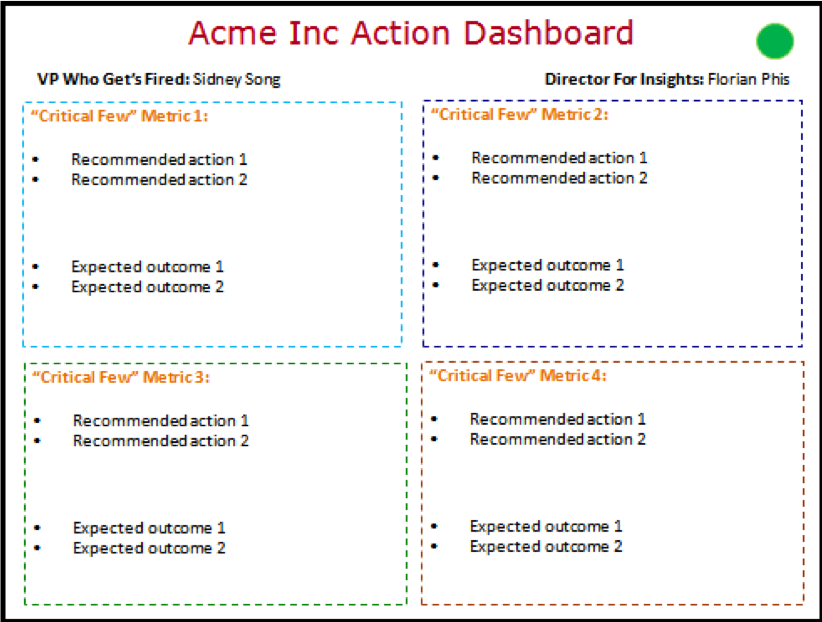

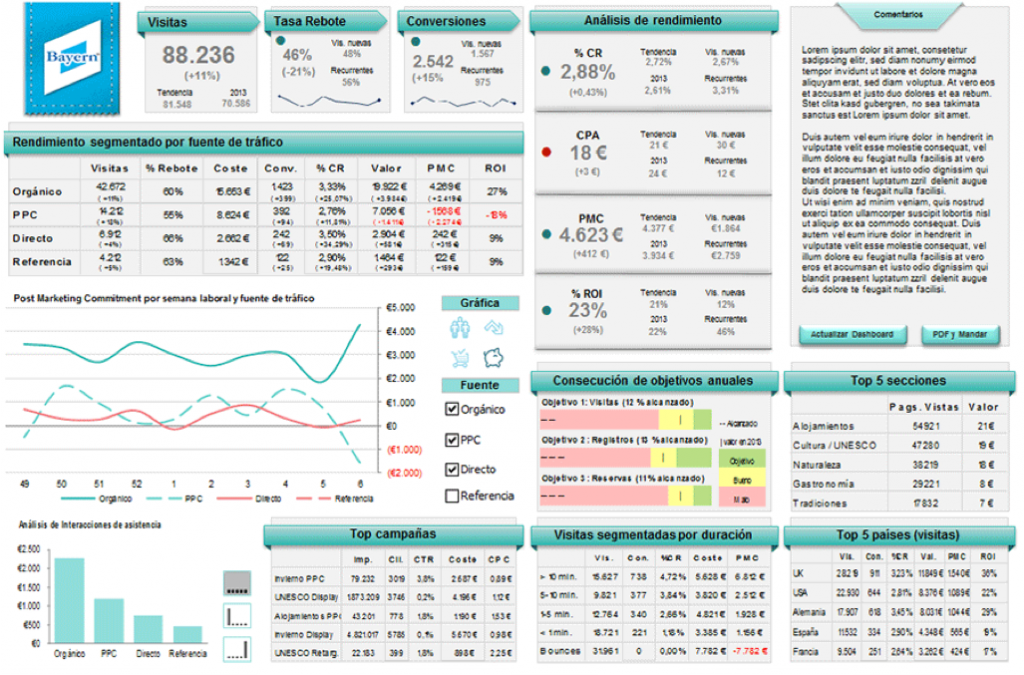

Ejemplos de dashboard

Para terminar el artículo, os dejo con varios ejemplos de varios tipos de cuadros de mando.

Avinash Kaushik dashboard para gerencia de empresa

.

Agustín Suárez – Dashboard de Marketing

.

Fuente: tristanelosegui.com, 2019.

___________________________________________________________________

Vincúlese a nuestras Redes Sociales:

LinkedIn YouTube Facebook Twitter

___________________________________________________________________

.

.

Cómo los sesgos cognitivos afectan nuestro juicio

abril 22, 2020

25 Heurísticos y Sesgos Cognitivos: nuestros errores de juicio

Por Marta Guerri.

¿Qué son los sesgos cognitivos?

Ya sea porque nuestro cerebro posee una capacidad limitada, o porque no siempre disponemos de toda la información que desearíamos o porque nos embarga la incertidumbre de las consecuencias de tomar una u otra decisión, por lo que en muchas ocasiones tomamos “atajos” mentales para llegar a la solución de los problemas. Estos atajos mentales que tomamos de forma inconsciente, en psicología se llaman “Heurísticos”, y nos ayudan a simplificar la gran cantidad de procesos mentales que llevamos a cabo constantemente y a hacer más llevadera nuestra vida diaria.Publicidad

Y es que nuestro cerebro no es capaz de procesar toda la información que recibe a través de los sentidos, por lo que necesita hacer una selección de la misma. Cuando nuestros atajos mentales o heurísticos nos conducen a errores de conclusión, les llamamos sesgos cognitivos.

Los principales sesgos cognitivos que se conocen

Sesgo de memoria

Todos sabemos que nuestra memoria no es perfecta, se difumina con el tiempo y fácilmente nos induce a errores inconscientes. Las investigaciones realizadas revelan que cuando evaluamos recuerdos para poder tomar decisiones sobre nuestro futuro, a menudo se muestran sesgados por los acontecimientos que son muy positivos o muy negativos, y es que tendemos a recordar los hechos insólitos o poco habituales más que acontecimientos diarios, cotidianos. La cusa es que el cerebro da mucha más importancia a los fenómenos extraordinarios o no tanta a usuales, seguramente debido a la importancia que estos tenían en el aprendizaje a lo largo de la evolución. Como resultado, ese sesgo de nuestra memoria afecta a nuestra capacidad de predicción en el futuro.

Para poder evitar ese sesgo se recomienda tratar de recordar el mayor número posible de eventos similares, de esta forma se pretende evitar caer en los extremos, a menudo poco representativos.Publicidad

Falacia de planificación

Este sesgo se refiere a la tendencia que tenemos a subestimar el tiempo que tardamos en terminar una tarea. Al parecer tendemos a planear los proyectos con cierta falta de detalle que nos permitiría la estimación de las tareas individuales. La falacia de la planificación no solo provoca demoras, sino también costos excesivos y reducción de beneficios debido a estimaciones erróneas.

Como dice el científico estadounidense Douglas Hofstadter hay que tener presente que «Hacer algo te va llevar siempre más tiempo de lo que piensas, incluso si tienes en cuenta la Ley de Hofstadter». La ley de Hofstadter es un adagio autorreferencial, acuñado por Douglas Hofstadter en su libro Gödel, Escher y Bach para describir la dificultad ampliamente experimentada de estimar con precisión el tiempo que llevará completar tareas de complejidad sustancial.

Ilusión de control

Este sesgo se encuentra detrás de muchas supersticiones y comportamientos irracionales. Es la tendencia que tenemos a creer que podemos controlar ciertos acontecimientos, o al menos a influir en ellos. Es gracias a este pensamiento que los humanos, desde tiempo inmemorial, creamos rituales y supersticiones que nos aportan cierta seguridad. Un ejemplo de la actualidad se puede ver en los deportistas que repiten ciertas conductas esperando que condicionen cosas como su capacidad de marcar goles, y que evidentemente depende de muchos otros factores objetivos.

Sesgo de apoyo a la elección

En el momento en que elegimos algo (desde una pareja a una pieza de ropa) tendemos a ver esa elección con un enfoque más positivo, incluso si dicha elección tiene claros defectos. Tendemos a optimizar sus virtudes y minimizamos sus defectos.

Efecto de percepción ambiental

Aunque nos parezca extraño, el ambiente que nos rodea ejerce una gran influencia en el comportamiento humano. Un ambiente deteriorado, caótico y sucio provoca que las personas se comporten de manera menos cívica, y también les inclina a cometer más acciones vandálicas y delictivas. Este efecto es la base de la «teoría de las ventanas rotas» estudiado por el psicólogo Philip Zimbardo.

Sesgo de disponibilidad

El sesgo o heurístico de disponibilidad es un mecanismo que la mente utiliza para valorar qué probabilidad hay de que un suceso suceda o no. Cuando más accesible sea el suceso, más probable nos parecerá, cuanto más reciente la información, será más fácil de recordar, y cuanto más evidente, menos aleatorio parecerá.

Este sesgo cognitivo se aplica a muchísimas esferas de nuestra vida, por ejemplo, se ha demostrado que doctores que han diagnosticado dos casos seguidos de una determinada enfermedad no muy usual, creen percibir los mismos síntomas en el próximo paciente, incluso siendo conscientes de que es muy poco probable (estadísticamente hablando) diagnosticar tres casos seguidos con la misma enfermedad. Otro ejemplo es el de una persona que asegura que fumar no es tan dañino para la salud, basándose en que su abuelo vivió más de 80 años y fumaba tres cajetillas al día, un argumento que pasa por alto la posibilidad de que su abuelo fuera un caso atípico desde el punto de vista estadístico.

En el fondo consiste en sobreestimar la importancia de la información disponible (y extraer por tanto conclusiones erróneas). Las loterías por ejemplo, explotan el sesgo de la disponibilidad, y es que si las personas comprendiesen las probabilidades reales que tienen de ganar, probablemente no comprarían nunca más un décimo en su vida.

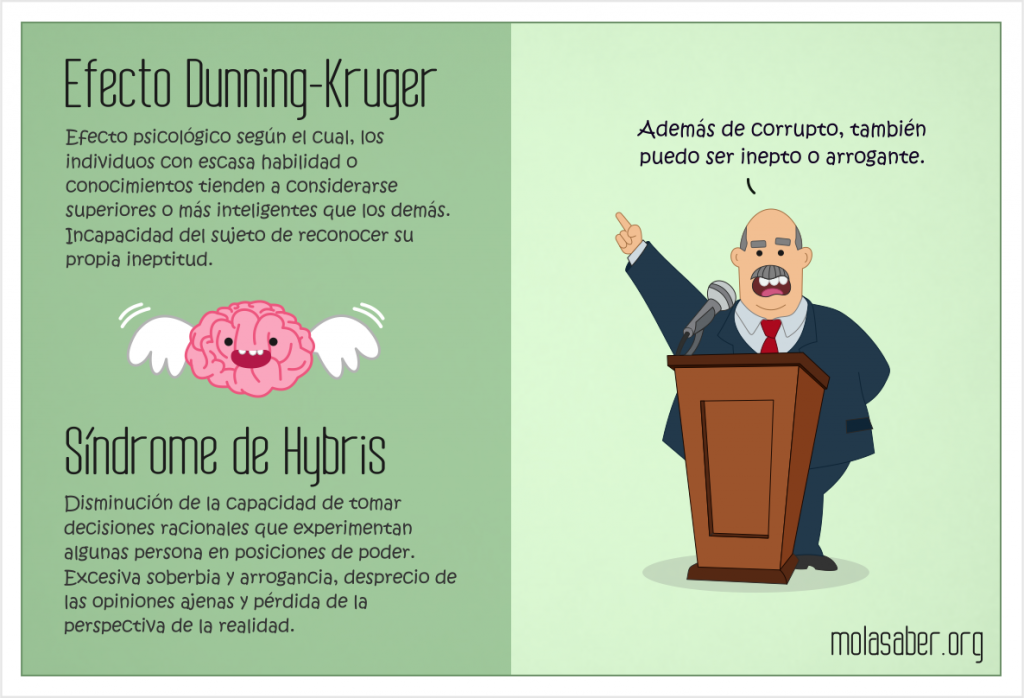

El efecto Dunning-Kruger

El efecto Dunning-Kruger sesgo cognitivo consiste en una de autopercepción distorsionada, según la cual los individuos con escasas habilidades o conocimientos, piensan exactamente lo contrario; se consideran más inteligentes que otras personas más preparadas, están en la certeza de que son superiores de alguna forma a los demás, midiendo así incorrectamente su habilidad por encima de lo real. Esta distorsión se debe a la inhabilidad cognitiva del sujeto de reconocer su propia ineptitud, debido a que su habilidad real debilitaría su propia confianza y autoestima. Por el contrario, los individuos competentes asumen, falsamente, que los otros tienen una capacidad o conocimiento equivalente o incluso superior al suyo.

Los autores de este descubrimiento David Dunning y Justin Kruger de la Universidad de Cornell, trataron de averiguar si existía algún remedio para nivelar la autoestima sobrevalorada de los más incapaces. Por suerte resultó que sí lo había: la educación. El entrenamiento y la enseñanza podían ayudar a estos individuos incompetentes a darse cuenta de lo poco que sabían en realidad.

Ya lo dijo en su momento Charles Darwin: “La ignorancia engendra más confianza que el conocimiento”.

Efecto halo

El efecto de halo es un sesgo cognitivo por el cual la percepción de un rasgo es influenciado por la percepción de rasgos anteriores en una secuencia de interpretaciones. O sea, si nos gusta una persona, tendemos a calificarla con características favorables a pesar de que no siempre disponemos de mucha información sobre ella, por ejemplo, pensamos de alguien que es simpático, y esto nos hace presuponer que ya conocemos otras características más específicas como: también es inteligente.

El mejor ejemplo para entender este sesgo son las estrellas mediáticas (actores, cantantes, famosos…) demuestran el efecto de halo perfectamente. Debido a que a menudo son atractivos y simpáticos, entonces y de manera casi automática, suponemos que también son inteligentes, amables, poseen buen juicio y así sucesivamente. El problema aparece cuando estas suposiciones son erróneas, ya que se basan a menudo en aspectos superficiales.

Esta tendencia parece estar presente incluso en todos los niveles sociales, tanto bajos como altos, incluyendo donde la objetividad es primordial. Por ejemplo, se ha demostrado que, de media, a la gente atractiva le caen penas de prisión más cortas que otros que fueron condenados por delitos similares.

Sesgo del poder corrupto

Seguro que a muchos no les va a de extrañar la realidad de este sesgo, que dice que hay una tendencia demostrada en la que los individuos con poder son fácilmente corrompibles, en especial cuando sienten que no tienen restricciones y poseen plena libertad. ¿Les suena de algo? Políticos, empresarios, actores famosos, deportistas de élite e incluso la realeza están llenos de casos de corrupción.

Sesgo de proyección

Este sesgo nos habla de la tendencia inconsciente a asumir que los demás poseen pensamientos, creencias, valores o posturas parecidas a las nuestras. Como si fueran una proyección de nosotros mismos.Publicidad

Efecto del lago Wobegon o efecto mejor que la media

Es la tendencia humana a autodescribirse de manera favorable, comunicando las bondades de uno mismo y pensar que se encuentra por encima de la media en inteligencia, astucia u otras cualidades. Llamado también síndrome de superioridad ilusoria.

Sesgo de impacto

Este sesgo se refiere a la tendencia que tenemos a sobreestimar nuestra reacción emocional, sobrevalorando la duración e intensidad de nuestros futuros estados emocionales. Pero las investigaciones muestran que la mayoría de las veces no nos sentimos tan mal como esperábamos cuando las cosas no van como queremos, por ejemplo. Este sesgo es una de las razones por la que a menudo nos equivocamos en la predicción sobre cómo nos afectarán emocionalmente los acontecimientos futuros. Los estudios han demostrado que meses después de que una relación termine, las personas no suelen ser tan infelices como esperaban y que personas a las que le ha tocado la lotería, con el tiempo vuelven a su grado de felicidad habitual o que tenían antes de ganar el premio.

Efecto del falso consenso

El sesgo de falso consenso efecto es parecido al antes descrito sesgo de proyección, y es que la mayoría de personas juzgan que sus propios hábitos, valores y creencias están más extendidas entre otras personas de lo que realmente están.

Heurístico de representatividad

Este heurístico es una inferencia que hacemos sobre la probabilidad de que un estímulo (persona, acción o suceso) pertenezca a una determinada categoría. Por ejemplo, si decimos que Álex es un chico joven metódico cuya diversión principal son los ordenadores. ¿Qué le parece más probable?, ¿que Álex sea estudiante de ingeniería o de humanidades?

Cuando se hacen preguntas de este tipo, la mayoría de la gente tiende a decir que seguramente Álex estudia ingeniería. Un juicio así resulta, según el psicólogo Daniel Kahneman de la aplicación automática (inmediata o no) del heurístico de representavidad. Suponemos que estudia ingeniería porque su descripción encaja con un cierto estereotipo de estudiante de ingeniería. Pero esto pasa por alto hechos como que, por ejemplo, los estudiantes de humanidades son mucho más numerosos que los de ingeniería, por lo que sería mucho más probable encontrar estudiantes de humanidades que se correspondan con esta descripción.

Este sesgo no solo es anecdótico, sino que forma parte del fundamento de ciertos prejuicios sociales. Por ejemplo, cuando juzgamos la conducta de un miembro de un determinado colectivo, como los inmigrantes, tendemos muchas veces a basarnos en estereotipos supuestamente representativos, ignorando datos objetivos de frecuencia y probabilidad.

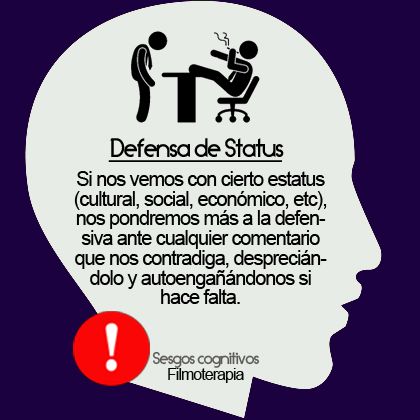

Defensa de status

Este sesgo se refiere a cuando una persona considera que posee cierto status, tenderá a negar y a defenderse de cualquier comentario que lo contradiga, aun si para ello debe autoengañarse.

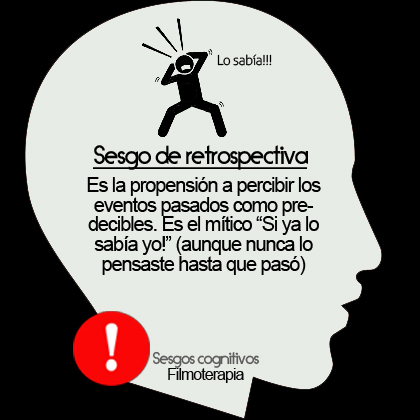

Prejuicio de retrospectiva o recapitulación

Es la tendencia que tenemos a ver los hechos pasados como fenómenos predecibles. Las personas sesgamos nuestro conocimiento de lo que realmente ha pasado cuando evaluamos nuestra probabilidad de predicción. En realidad este es un error en la memoria. De la misma manera que también tenemos tendencia a valorar los eventos pasados de una forma más positiva a como ocurrieron en realidad.

Error fundamental de atribución

Se refiere a la tenencia que mostramos a priorizar nuestras dotes personales para valorar nuestros éxitos y a atribuir a las circunstancias externas nuestros fracasos. En cambio cuando se trata de otra persona, la tendencia es la inversa, atribuimos a la suerte o la ayuda sus éxitos y a características internas sus fallos.

Sesgo de disconformidad

Es la tendencia que tenemos a hacer una crítica negativa a la información que contradice nuestras ideas, mientras que aceptamos perfectamente aquella que es congruente con nuestras creencias o ideologías. De este modo se produce una percepción selectiva por la cual las personas perciben lo que quieren en los mensajes de los demás o de los medios de comunicación. y es que por lo general las personas tendemos a ver e interpretar las cosas en función de nuestro marco de referencia. También tenemos más probabilidades de buscar información favorable a nuestras ideas que buscar información que desafíe nuestras ideologías o línea de pensamiento.

Efecto Forer o efecto de validación subjetiva

El efecto Forer es la tendencia a aceptar descripciones personales vagas y generales como excepcionalmente aplicables a ellos mismos, sin darse cuenta que la misma descripción podría ser aplicada a cualquiera. Este efecto parece explicar, por lo menos en parte, por qué tanta gente piensa que las pseudociencias funcionan, como la astrología, cartomancia, quiromancia, adivinación, etc., porque aparentemente proporcionan análisis acertados de la personalidad. Los estudios científicos de esas pseudociencias demuestran que no son herramientas válidas de valoración de la personalidad, sin embargo cada una tiene muchos adeptos que están convencidos de que son exactas.

Heurístico de anclaje y ajuste o efecto de enfoque

Este heurístico describe la tendencia humana a confiar demasiado en la primera información que obtienen para luego tomar decisiones: el «ancla». Durante la toma de decisiones, el anclaje se produce cuando las personas utilizan una “pieza” o información inicial para hacer juicios posteriores. Una vez que el ancla se fija, el resto de información se ajusta en torno a ella incurriendo en un sesgo.

Por ejemplo, si preguntamos a unos estudiantes 1) ¿cómo de feliz te sientes con tu vida? y 2) ¿cuántas citas has tenido este año?, tenemos que la correlación es nula (según las respuestas tener más citas no alteraría el nivel de bienestar). Sin embargo, si se modifica el orden de las preguntas, el resultado es que los estudiantes con más citas se declaran ahora más felices. Es falto de lógica, pero al parecer, focalizar su atención en las citas hace que exageren su importancia.

Ilusión de frecuencia

Al parecer, cuando un fenómeno ha centrado nuestra atención recientemente, pensamos que este hecho de repente aparece o sucede más a menudo, aunque sea improbable desde el punto de vista estadístico. En realidad, esto ocurre porque ahora nosotros lo percibimos de forma diferente (antes no le prestábamos atención) y por lo tanto creemos erróneamente que el fenómeno se produce con más frecuencia.

Ilusión de la confianza

Este sesgo se trata de la confusión entre la confianza de quien nos habla con su credibilidad, de tal manera que percibimos a una persona como más creíble cuanta más confianza muestra en sus argumentaciones. La realidad es que las investigaciones han demostrado que la confianza no es un buen indicador, ni tampoco es una forma fiable de medir la capacidad o aptitud de una persona.

Punto de referencia o status-quo

Al parecer un mismo premio no posee igual valor para dos personas diferentes. Por ejemplo, si tengo dos mil euros y gano cien en una apuesta, lo valoro menos que si tengo quinientos euros y gano esos mismos cien en la apuesta. El punto de referencia es muy importante. Pero sus implicaciones pueden ser algo mayores, pues no sólo se trata de la referencia que tengo respecto a mi propia riqueza inicial, sino con la riqueza de mi círculo de personas cercano. Si alguien desconocido para mi gana cien mil euros en la lotería, yo no me veo afectado. En cambio, si los gana mi compañero de trabajo, me da la sensación de que soy más pobre y desgraciado, aunque no hubiera jugado a la lotería.

Efecto Bandwagon o efecto de arrastre

Este error consiste en la tendencia a hacer (o creer) cosas sólo porque muchas otras personas hacen (o creen) dichas cosas. Al parecer, la probabilidad de que una persona adopte una creencia aumenta en función del número de personas que poseen esa creencia. Se trata de un fuerte pensamiento de grupo.

Efecto Keinshorm

Es la predisposición a contradecir sistemáticamente las ideas o formulaciones que otra persona hace y con la cual no se simpatiza, sólo por este hecho, pues ya no deseamos que tenga la razón y estamos más predispuestos a no creer en sus palabras.

Fuente: psicoactiva.com

.

.

El Chief Data Officer en España

abril 17, 2020

El CDO en la empresa española: ¿Tecnología o estrategia?

El Club Chief de Data Officers Spain es la primera comunidad de CDOs de España y en el debate celebrado en la sesión de septiembre pasado se celebró un debate para dar voz a todos los asistentes en el que intervino Ana Gadea, partner de la firma Management Solutions, que inició un debate sobre el lugar que ocupa el Chief Data Officer en la empresa española. Durante la discusión, quedó patente que la ubicación del CDO no está estandarizada actualmente, pero todo parece indicar a que pivotará desde posiciones más cercanas a IT a otras más estratégicas, próximas a la Alta Dirección.

Este movimiento será natural a medida que la alta dirección pueda constatar, con casos reales, todo el potencial del análisis de datos para el desarrollo del negocio:Como reza el dicho, el camino se demuestra andando”, señala Juan Francisco Riesco, Director de Datos de Mutua Madrileña. “En las etapas iniciales, cuando la estrategia analítica no es aún lo suficientemente madura, es importante seleccionar un ámbito de actuación visible y sencillo para desarrollar casos de uso que demuestren el valor del dato,

una opinión con la que coincide Manuel Ferro, CDO de Abanca, quien recomienda: Empezar con objetivos pequeños e ir creciendo de manera escalonada. El CDO debe estar sentado en la misma mesa que el resto de tomadores de decisiones, a quienes facilita y debe facilitar su labor mediante el análisis y gobernanza del dato. Esto se debe a que, si bien su rol es tecnológico, su función tiene claras implicaciones para toda la empresa, una realidad que comprenden fácilmente las empresas data driven.

En el caso de Inditex, según indica su Head of Data Office, Jesús Salceda, «La cultura analítica siempre ha formado parte de nuestra empresa, que es lo más importante. Obviamente, a medida que una empresa crece y gestiona más datos, necesita incorporar nuevas herramientas que posibiliten esta tarea, pero lo que realmente marca la diferencia es el hecho de tomar conciencia de la importancia tomar decisiones en base al análisis de datos.«

El CDO, como principal impulsor de la cultura analítica, es también quien mayor visión posee para afrontar la gestión del cambioEn otro punto del debate, Gadea planteó una duda relativa a la ubicación actual del CDO en el organigrama corporativo: ¿tiene sentido que esté ubicado en áreas de IT? En palabras de Pedro López-Montenegro, CDO de Banco Santander,

«Estar situado en el entorno de operaciones es algo natural, por el componente tecnológico del cargo, y tiene muchas ventajas, pues ayuda al CDO proporcionándole capacidad de acción y una visión transversal de la compañía. Pero “confinarle” en este área también hace que el CDO pierda poder de negociación frente a la alta dirección. Su rol debe evolucionar para ganar poder de prescripción y ser capaz, en última instancia, de situar el dato como verdadero pilar estratégico de las empresas.»

Asimismo, durante el debate se destacó una habilidad actualmente muy relevante: la diplomacia y negociación corporativa. El CDO, como principal impulsor de la cultura analítica, es también quien mayor visión posee para afrontar la gestión del cambio. Por otra parte, su capacidad para demostrar el valor de los datos será útil a la hora implantar figuras de gobierno del dato definidas, una prioridad para eliminar posibles zonas grises, como las dudas sobre la responsabilidad sobre el control de calidad de la información, su protección y su arquitectura.

La relevancia de la cultura Data Driven

Para desarrollar una cultura Data Driven madura, es esencial conocer un lenguaje común, el lenguaje de los datos: todos los miembros del equipo deben moverse en el mismo terreno de juego porque: “El compromiso total de todos los miembros del equipo”, tal y como subraya Francisco Escalona, Big Data Manager de Orange, es muy importante. Según Riesco, “Evangelizar cuesta mucho trabajo y para no menoscabar esta tarea es importante demostrar, mediante casos de uso sencillos, lo que la analítica puede hacer por la empresa”.

De esta manera, como apunta David Martín, CDO & Big Data Architect de Damavis Studio,“Se podrán desplegar soluciones cada vez más complejas y útiles, como proyectos basados en machine learning para ofrecer análisis de datos avanzado en tiempo real”.

Cada vez será más fácil demostrar a la alta dirección el potencial de la estrategia analítica y cómo puede mejorar el negocio. La clave es escoger un caso de uso sencillo y escalable para que, poco a poco, la analítica forme parte de la naturaleza de las organizaciones.Los datos formarán serán a las empresas lo que el aire es a las personas. Serán una parte esencial de cada proceso y se situarán en el centro de la toma de decisiones estratégicas. Esta realidad será más y más común y la gestión del dato evolucionará a medida que más miembros del equipo hablen su lenguaje.

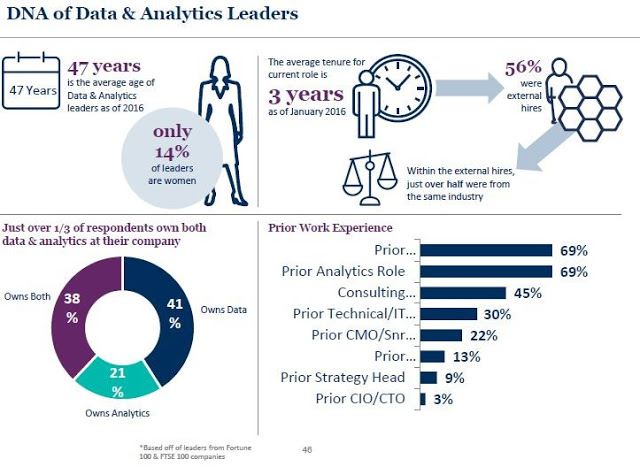

Infografía: El ADN de los CDO

- 47 años: es la edad media del CDO

- El 14% son mujeres

- Permanencia media en el cargo: 3 años

- El 56% de los CDO son incorporaciones externas para las compañías. De este porcentaje, la mitad procede del mismo sector.

- Solo un tercio de los CDO está al cargo tanto de la gobernanza del dato como de su análisis

Post escrito por el Club Chief Data Officer Spain

El Club de Chief Data Officer Spain es la primera comunidad de CDOs en España, Si quieres conocer más sobre el Club, escribe a: clubcdospain@outlook.es

Fuente: empresas.blogthinkbig.com, 2019.

.

.

.

Cloacas y Big Data

junio 27, 2019

Un proyecto Big Data analizará los hábitos de los barceloneses… mediante las alcantarillas

Un proyecto europeo usa Big Data e inteligencia artificial para generar información sobre los hábitos de los ciudadanos de Barcelona a partir del análisis químico, microbiológico y de caudales de las aguas residuales en el alcantarillado.

¿Qué tiene que ver el alcantarillado de una ciudad como Barcelona con la personalidad de los barrios que la componen? Aunque parezca una pregunta absurda, ese es el objetivo de un ambicioso proyecto de investigación que pretende usar las tecnologías de Big Data e inteligencia artificial para generar información sobre el estilo de vida y los hábitos diarios de los ciudadanos… a partir de sus aguas residuales.

En concreto, los investigadores quieren conocer los hábitos de gestión de residuos en los hogares, incluyendo la adecuada gestión de los aceites y las grasas y de las toallitas húmedas, así como los hábitos de consumo de productos farmacéuticos, como los antibióticos.

Esta información se obtendrá a partir del análisis químico, microbiológico y de caudales de las aguas residuales en el alcantarillado y, como decíamos, mediante la aplicación de Inteligencia Artificial y Big Data.

Esta aproximación pionera, bautizada como sewage sociology o sociología de las aguas residuales, será clave en el futuro inmediato para diseñar campañas de concienciación ciudadana en los ámbitos de gestión de residuos en los hogares y de hábitos de salud y hacer un seguimiento de su eficacia, dicen los impulsores de este proyecto.

Por otra parte, los gestores del alcantarillado tendrán una herramienta más para realizar un mantenimiento preventivo que implicará ofrecer un mejor servicio a los ciudadanos.

La iniciativa está comandada por el Instituto Catalán de Investigación del Agua (ICRA), el centro tecnológico Eurecat, el Consorcio Instituto de Estudios Regionales y Metropolitanos de Barcelona (IERMB), el fabricante de sensores s::can Iberia y Barcelona Ciclo del Agua (BCASA) participan en el proyecto.

Esta investigación es uno de los capítulos de la iniciativa europea SCOREwater, que busca contribuir a la transformación digital del sector del agua, el cual está previsto que se prolongue durante cuatro años y cuenta con un presupuesto de 5,8 millones de euros para los tres proyectos de Barcelona, Gotemburgo (Suecia) y Amersfoort (Holanda).

*Artículo original publicado en Business Insider

Etiquetas: Big Data, Smart Cities

Fuente: ticbeat.com, 08/06/19.

Más información:

De Big Brother a Little Brother

Big Data y el Control social en Venezuela

La Inteligencia y sus especialidades en la Sociedad del conocimiento

______________________________________________________________________________

Vincúlese a nuestras Redes Sociales:

LinkedIn YouTube Facebook Twitter

______________________________________________________________________________

.

.

Geopolítica e Inteligencia de Negocios

octubre 13, 2018

De la inteligencia comercial a la geopolítica en el nuevo orden mundial indirecto

Por Mónica Niño Romero.

La prospección de mercados en la era digital viene dada por utilizar herramientas de análisis de datos. Detectar las señales de negocio en la exploración Business to Business (B2B) es imprescindible en la implementación de acciones de inteligencia en la venta corporativa. Las redes sociales son canales con multitud de datos e interactuaciones de comunicación bidireccional, que deben ser analizados con perspectiva digital.

La prospección de mercados en la era digital viene dada por utilizar herramientas de análisis de datos. Detectar las señales de negocio en la exploración Business to Business (B2B) es imprescindible en la implementación de acciones de inteligencia en la venta corporativa. Las redes sociales son canales con multitud de datos e interactuaciones de comunicación bidireccional, que deben ser analizados con perspectiva digital.

El big data supone un foco de información muy potente para el desarrollo de negocio. Las soluciones de inteligencia comercial B2B optimizan recursos y afinan los resultados de forma objetiva, segmentando, para desarrollar una estrategia eficiente. La agrupación de todos los millones de datos en internet, redes sociales, foros, etc. determina un posicionamiento, teniendo en cuenta el mercado y el target, para llevar a cabo un plan de marketing enfocado desde el social selling.

El campo de acción de los directorios comerciales pasa por ser herramientas de marketing digital, con la posibilidad de ser potentes aplicaciones de inteligencia digital. Todo lo que aporte y genere información para que sea transformado en valor añadido será susceptible de incorporarse a tareas de inteligencia.

La inteligencia comercial puede incluirse dentro de la inteligencia corporativa o empresarial. A través de los datos se crean estrategias, que producen tendencias. Generalmente las empresas organizan esto a través del Desarrollo de Negocio. Emanan sus objetivos de la inteligencia corporativa o estrategia de la empresa.

En definitiva, la inteligencia se aplica a múltiples escenarios, desde el ámbito militar hasta las operaciones financieras pasando por las empresas y corporaciones con el enfoque hacia las ventas. Es el uso de la información, a través de los datos, con una aplicación y hacia la toma de decisiones. Aunque cada vez sea más determinante el uso de los datos personales y sus normativas. De aquí la inminente llegada del Reglamento General de Protección de Datos (GDPR) de la Unión Europea.

En 1958 un investigador de IBM, Hans Peter Luhn, crea el término “Inteligencia de negocio” Business Intelligence, que es “la habilidad de aprender las relaciones de hechos presentados de forma que guíen las acciones hacia una meta deseada”. Se comienzan a crear las primeras bases de datos, los informes y análisis con la analítica de datos, determinando un camino de largo recorrido .

El imperio de los datos

La tercera dimensión de la comunicación, es decir, las redes sociales, comienza a dar frutos a través del valor añadido de las conversaciones virtuales. Su uso, mal uso o abuso está en entredicho por diversos casos. Ya se ha utilizado como minería de datos (data mining) para comunicación estratégica en política. Tenemos varios casos recientes: Cambridge Analítica, la venta de datos por Facebook … De aquí al uso geopolítico va un paso. Señalaba el escritor Moisés Naim en su libro “El fin del poder” nuevos factores geoestratégicos, como son los micropoderes o la incursión de agentes indirectos. “El poder, entendido de forma tradicional como tal, se está volviendo cada vez más débil y, por tanto, más efímero” se extrae de este tratado.

La conquista -ya sea de la compra, ya sea de los territorios o ya sea de las voluntades- era antes directa. Lo señala el experto Pedro Baños en su obra “Así se domina el mundo“: los poderosos conquistaban países que gobernaban de forma hegemónica; ahora -y desde hace ya un tiempo- la inteligencia utiliza medios indirectos: cultura, economía, psicología, redes sociales.

Esto puede producir una degradación del poder y un acortamiento de los periodos en que se detenta el poder -los mandatos políticos se abrevian-, por tanto, se potencia el surgimiento de nuevos autoritarismos, violentos a la vez que volátiles, y aupados viralmente. La geoestrategia es ahora tecnopolítica y la inteligencia comercial es aplicable a todo. Ya lo decía Lenin: “la política no es más la que la expresión concentrada de la economía”.

Fuente: observatorio.cisde.es, 14/05/18.

Moneyball, el juego de la fortuna. Un caso de Inteligencia de Negocios.

septiembre 3, 2018

Moneyball

Fuente: https://youtu.be/Uwg5SjH-f2g – Estadística para Administración

.

Moneyball es una película de 2011 dirigida por Bennett Miller y protagonizada por Brad Pitt, Jonah Hill y Philip Seymour Hoffman. Es una adaptación de la novela Moneyball: the art of winning an unfair game (2003), basada en la historia real de Billy Beane, gerente general del equipo Oakland Athletics, quien utilizaba las estadísticas avanzadas para fichar jugadores.

Es un buen ejemplo de Inteligencia de Negocios (business intelligence).

Sinopsis

Billy Beane (Brad Pitt) es el gerente general del equipo de béisbol Oakland Athletics, que acaba de perder otra temporada más. Decidido a relanzar el equipo, y con la ayuda del joven economista Peter Brand (Jonah Hill), utilizará las estadísticas de este para fichar a los jugadores que cree más oportunos. Un método que no es compartido por sus compañeros, ni por el entrenador del equipo Art Howe (Philip Seymour Hoffman).

Argumento detallado

El gerente general de los Athletics de Oakland, Billy Beane (Brad Pitt), está molesto por la derrota de su equipo ante los Yankees de Nueva York en la postemporada del 2001. Con la inminente perdida de los jugadores estrella Johnny Damon, Jason Giambi, y Jason Isringhausen a agencia libre, Beane trata de diseñar una estrategia para armar un equipo competitivo para el 2002, pero se esfuerza por superar la nómina de jugadores limitados de Oakland. Durante una visita a los Indians de Cleveland, Beane se encuentra con Peter Brand (Jonah Hill), un joven economista graduado en Yale con ideas radicales sobre la forma de evaluar a los jugadores. Beane prueba la teoría de Brand al preguntarle si lo habría fichado (apenas salido de la escuela secundaria); Beane había sido jugador en las Grandes Ligas antes de convertirse en mánager general. Aunque los scouts consideraban a Beane un jugador fenomenal, su carrera en las Grandes Ligas fue decepcionante. Después de cierto estímulo, Brand admite que él no lo habría fichado hasta la novena ronda y que Beane probablemente debería haber aceptado una beca para estudiar en Stanford en su lugar.

El gerente general de los Athletics de Oakland, Billy Beane (Brad Pitt), está molesto por la derrota de su equipo ante los Yankees de Nueva York en la postemporada del 2001. Con la inminente perdida de los jugadores estrella Johnny Damon, Jason Giambi, y Jason Isringhausen a agencia libre, Beane trata de diseñar una estrategia para armar un equipo competitivo para el 2002, pero se esfuerza por superar la nómina de jugadores limitados de Oakland. Durante una visita a los Indians de Cleveland, Beane se encuentra con Peter Brand (Jonah Hill), un joven economista graduado en Yale con ideas radicales sobre la forma de evaluar a los jugadores. Beane prueba la teoría de Brand al preguntarle si lo habría fichado (apenas salido de la escuela secundaria); Beane había sido jugador en las Grandes Ligas antes de convertirse en mánager general. Aunque los scouts consideraban a Beane un jugador fenomenal, su carrera en las Grandes Ligas fue decepcionante. Después de cierto estímulo, Brand admite que él no lo habría fichado hasta la novena ronda y que Beane probablemente debería haber aceptado una beca para estudiar en Stanford en su lugar.

Los cazatalentos del equipo son los primeros desconfiados por nuevo enfoque de Brand, sobre todo Grady Fuson – quien es despedido por Beane después de discutir con él a causa del nuevo rumbo deportivo del equipo; después critica en los medios de comunicación las decisiones tomadas por Beane y pone en duda el futuro del equipo. En lugar de basarse en la experiencia de los cazatalentos y la intuición, Brand selecciona a jugadores basados casi exclusivamente en su porcentaje de base (OBP). Al encontrar a los jugadores con un alto OBP pero con características que conducen a los cazatalentos a despedirlos, Brand reúne a un equipo de jugadores infravalorados con mucho más potencial del que se les reconoce y a un precio mucho más económico que las grandes estrellas. A pesar de las vehementes objeciones de los cazatalentos, Beane apoya la teoría de Brand y contrata a los jugadores que seleccionó, como el heterodoxo lanzador submarino Chad Bradford (Casey Bond). Tras los fichajes de agentes libres, Beane se da cuenta que también se enfrenta a la oposición de Art Howe (Philip Seymour Hoffman), mánager de los Athletics. Con las tensiones ya elevadas entre ellos a causa de una disputa contractual, Howe no tiene en cuenta la estrategia de Beane y Brand, y juega el equipo en un estilo tradicional, sin tener en cuenta las indicaciones de Beane.

A principios de la temporada, a los Athletics les va mal, por lo que Beane es fuertemente criticado y ya vaticinan el fracaso del nuevo modelo y su despido como gerente general. Beane convence al propietario a mantener el rumbo, y con el tiempo el equipo comienza a mejorar. En última instancia, los Athletics ganan 20 partidos consecutivos, estableciendo el récord de la Liga americana. Su racha se limita con una victoria sobre los Royals de Kansas City. Al igual que muchos jugadores de béisbol, Beane es supersticioso y evita asistir a los partidos. Su hija le implora que vaya al partido que supondría la victoria número 20 consecutiva contra los Royals, donde Oakland ya gana 11-0 después de la tercera entrada. Beane llega en la cuarta entrada, solo para ver que el equipo va a desintegrarse y, finalmente, permite a los Royals de igualar el marcador 11-11. Por último, los Athletics ganan, con un home-run en la última entrada por una de las selecciones de Brand, Scott Hatterberg. A pesar de todos sus éxitos en la segunda mitad de la temporada, los Ahletics pierden en la primera ronda de la postemporada, esta vez contra los Twins de Minnesota. Beane está decepcionado, pero satisfecho de haber demostrado el valor de los métodos de Brand. Beane se reúne más tarde con el propietario de los Red Sox de Boston, que se da cuenta de que el nuevo modelo utilizado por Beane es el futuro del béisbol, y se ofrece a contratar a Beane como gerente general de los Red Sox.

Para terminar, una nota de la película dice que Beane dejó pasar la oportunidad de convertirse en el gerente general de los Red Sox de Boston, a pesar de una oferta de un salario de 12,5 millones de dólares, lo que lo habría convertido en el gerente general mejor pagado en la historia del deporte. Regresa a Oakland para seguir administrando a los Oakland Athletics. Mientras tanto, dos años después de la adopción de la filosofía de fichajes utilizada en Oakland, los Red Sox de Boston ganan su primera Serie Mundial desde 1918.

Fuente: Wikipedia, 2018.

Vincúlese a nuestras Redes Sociales:

Google+ LinkedIn YouTube Facebook Twitter

.

.

Inteligencia Estratégica

julio 24, 2018

.

En un mundo globalizado y en una sociedad del conocimiento, con una producción de información creciente y abrumadora, las personas que toman decisiones en las organizaciones necesitan contar con sistemas y herramientas que les permitan orientar las estrategias en su organización. Para ello pueden emplear la Inteligencia Estratégica (IE). Un proceso de IE organizado, sistemático y permanente en el tiempo, precisa fundarse en el uso de las Tecnologías de la Información y la Comunicación (TIC).

Hoy en día la información es más necesaria que nunca y debe ser procesada en tiempo real para transformarse en conocimiento.

La utilización de la Inteligencia Estratégica es una forma de producir dicho conocimiento, indispensable para la conducción adecuada del Estado, los procesos gerenciales para toma de decisiones de una empresa y para una eficiente administración de todo tipo de instituciones.

La utilización de la Inteligencia Estratégica es una forma de producir dicho conocimiento, indispensable para la conducción adecuada del Estado, los procesos gerenciales para toma de decisiones de una empresa y para una eficiente administración de todo tipo de instituciones.

Para ser eficaces y eficientes, las organizaciones deben estar informadas -en tiempo real- sobre su entorno, a fin de identificar tempranamente las amenazas y las oportunidades que puedan surgir, potenciando sus fortalezas y minimizando sus debilidades.

La creciente necesidad de información organizada y sistematizada, que tienen los Estados y las organizaciones, explica el notable crecimiento e importancia que alcanza hoy la Inteligencia Estratégica.

Directorio

Sherman Kent, el creador de la Inteligencia Estratégica

Inteligencia de Negocios

Inteligencia de Negocios y Planeación Estratégica

Tendencias de Inteligencia de Negocios para 2018

Comunicación potenciada con Business Intelligence

Sistemas de Gestión de la Información en la Empresa

Especialización en Inteligencia Estratégica y Crimen Organizado

Inteligencia aplicada, Crimen Transnacional y Derecho de Policía

.

.

Vincúlese a nuestras Redes Sociales:

Google+ LinkedIn YouTube Facebook Twitter

.

.

Sistemas de Gestión de la Información en la Empresa

julio 24, 2018

Lecturas recomendadas

JOYANES AGUILAR, Luis. Sistemas de Gestión de la información en la empresa. México: Alfaomega, 2015.

.

.

.

Contenidos:

I: Los sistemas de información en organizaciones y empresas en la era de la nube y de los grandes datos: 1. Fundamentos de los sistemas de información — 2. Los sistemas de información en los negocios — 3. Tendencias e innovaciones tecnológicas y sociales en sistemas de información — 4. Infraestructuras de tecnologías de la información y plataformas tecnológicas de la década —

II: Infraestructuras de los sistemas de información: 5.Tecnologías móviles: el camino a la ubicuidad — 6. Web 2.0 y los medios sociales: social media — 7: Cloud computing: arquitectura y servicios — 8: Big —

III: Los datos y el conocimiento: administración, análisis y toma de decisiones: 9. Gestión — 10. NoSQL y en-memoria (in-memory) / Hadoop — 11. Gestión del conocimiento y herramientas colaborativas — 12. Inteligencia de negocios y Analítica (Business Intelligence y Analytics) — 13. Analítica Web — 14. Analítica social — 15. Analítica de Big Data (Big Data Analytics) — 16. Negocios digitales: e-business, e-commerce y m-commerce — 17. Empresa 2.0 y empresa social (social business): la empresa inteligente — 18. Estrategias de implantación de los sistemas de información en la empresa. El ciclo de vida de desarrollo de sistemas y la gestión de proyectos — 19. Modelos de sistemas de información de la empresa: ERP, CRM, SCM… — 20. Seguridad y ciberseguridad de los sistemas de información — 21. Gobierno y auditoría de las tecnologías y sistemas de información — 22. Ética, privacidad y responsabilidad social de la empresa —

Apéndice A: Redes de telecomunicaciones — Apéndice B: Internet y la Web — Apéndice C: Tendencias tecnológicas y roles profesionales en los sistemas de información gerenciales.

Editor: México, D. F. : Alfaomega, 2015

Descripción: 564 p.: gráfs.

ISBN: 9786076222249.

Temas: ADMINISTRACION DE EMPRESAS | SISTEMAS DE INFORMACION | BASES DE DATOS | COMERCIO ELECTRONICO | INNOVACIONES | TECNOLOGIA DE LA INFORMACION: Business Intelligence. Inteligencia de Negocios | RSE: Responsabilidad Social Empresaria | Web 2.0 | Inteligencia organizacional

Vincúlese a nuestras Redes Sociales:

Google+ LinkedIn YouTube Facebook Twitter

.

.

Comunicación potenciada con Business Intelligence

julio 24, 2018

Cómo sacar partido del Business Intelligence en tu estrategia de Comunicación

Estas herramientas son extremadamente útiles para facilitarnos la labor del día a día, pero cuando el volumen de noticias es elevado o bien las variables a analizar son cuantiosas, debemos comenzar a plantear cómo podemos extraer más valor de nuestros datos.

.

Existen diversas aplicaciones o herramientas que nos pueden ayudar a recabar información de forma rápida y sencilla con la capacidad de cruzar datos a tiempo real y permitirnos obtener valiosas conclusiones sobre nuestra actividad.

Lo que estas utilidades tienen en común es el potencial de transformar nuestros cotidianos análisis de cobertura en una plataforma dinámica e inteligente completamente adaptada a las necesidades del cliente:

-

Una herramienta viva.

Las plataformas que utilizan el business intelligence son capaces de alimentarse de la información que les proporcionamos de forma constante, de manera que los resultados se actualizan de forma automática y siempre están al día. Esta monitorización a tiempo real nos permite analizar tendencias y actuar a tiempo para maximizar nuestra campaña de comunicación o detectar potenciales crisis.

-

De un vistazo.

Con herramientas de business intelligence podemos configurar gráficos definidos de antemano adaptados a lo que más nos interesa para obtener información relevante de forma instantánea: número de noticias por medio, evolución en el tiempo, temáticas, formatos o tipologías de medios, etc. Además, son muy versátiles y nos permiten adaptar la presentación de los datos en función de las necesidades de cada momento o campaña.

-

Más allá del análisis cuantitativo.

El principal potencial del business intelligence es la capacidad de cruzar datos, una funcionalidad para la que nuestra hoja de cálculo resulta muy limitada. Combinar datos de diferentes hojas de cálculo y columnas para hacer comparativas entre períodos de tiempo, campañas o analizar el share of voice queda al alcance de un click.

-

El reto del análisis cualitativo.

El business intelligence nos ofrece numerosas posibilidades para presentar datos cualitativos de forma simple y eficaz, tales como el sentimiento, la presencia o la penetración de los mensajes. Si bien es preciso un análisis previo y minucioso del clipping, estas herramientas nos ayudarán a interpretar esa información con una perspectiva global.

¿A qué esperas para revolucionar tu medición de resultados?

Fuente: teamlewis.com, 2018.

Vincúlese a nuestras Redes Sociales:

Google+ LinkedIn YouTube Facebook Twitter

.

.